[2026-05-04 / Top 10] 로컬 LLM은 너드들이 큰 컴퓨터를 정당화하는 방법이다

DHH가 꼬집는 로컬 AI 열풍의 진짜 이유 — 성능이 아닌 자기합리화

개요

Ruby on Rails와 Basecamp의 창시자 David Heinemeier Hansson(DHH)이 로컬 LLM 열풍에 대한 신랄한 에세이를 발표했습니다. 제목부터 직설적입니다: “로컬 LLM은 너드들이 실제로 필요하지 않은 큰 컴퓨터를 정당화하는 방법이다.” 사생활 보호, 오프라인 동작, 커스터마이제이션이라는 명분 뒤에 숨겨진 고사양 하드웨어 구매 욕구를 꼬집는 이 글은 Hacker News에서 격렬한 찬반 토론을 불러일으켰습니다.

주요 내용

DHH의 핵심 주장

DHH는 로컬 LLM 붐을 몰고 오는 세 가지 명분이 있다고 지적합니다:

- 사생활 보호: “내 데이터가 클라우드에 안 간다”

- 오프라인 사용: “인터넷 없이도 AI를 쓸 수 있다”

- 커스터마이제이션: “모델을 직접 파인튜닝할 수 있다”

그러나 DHH는 이 명분들이 실질적으로 얼마나 자주 필요한가를 묻습니다. 대부분의 실제 사용 사례에서 클라우드 AI는 더 빠르고, 더 강력하며, 더 저렴합니다. 로컬 LLM에 드는 128GB RAM, M4 Max 또는 고사양 GPU의 실제 활용도는 많은 경우 마케팅 문구에 못 미친다는 것입니다.

“그래도 괜찮다”는 반전

흥미롭게도 DHH는 비판 후 이렇게 덧붙입니다: “하지만 그게 무슨 상관인가?” 고사양 하드웨어에 돈을 쓰고 싶어서 로컬 LLM을 명분으로 삼는 것 자체가 나쁜 건 아닙니다. 사람들은 항상 원하는 것을 구매할 합리적 이유를 찾아왔고, 로컬 LLM은 그런 역할로 충분히 기능한다는 것입니다. 문제는 이 명분이 진짜라고 스스로를 속이는 것이라고 지적합니다.

HN 커뮤니티의 반응

댓글은 두 진영으로 나뉘었습니다:

DHH 지지: “정확히 맞다. 로컬 LLM의 실용적 우위는 과장됐다. 대부분 취미용이다.”

반론: “사생활 보호는 진짜 필요다. 기업 환경에서 외부 API에 코드를 보내는 건 규정 위반이다.”, “개발도상국이나 인터넷 불안정 지역에서 오프라인 동작은 실제 필요다.”, “클라우드 의존성 자체가 리스크다.”

특히 의료·법률·금융 분야에서 규정 컴플라이언스상 클라우드 AI 사용이 제한되는 실제 사례들이 반론으로 제시됐습니다.

시사점

DHH의 에세이는 기술 커뮤니티가 자신의 소비 욕구를 합리화하는 방식에 대한 유머러스하지만 날카로운 성찰입니다. 동시에 로컬 LLM에 대한 과장된 기대와 실제 사용 사례 사이의 간극을 점검하게 만듭니다. 128GB RAM 미니 PC를 구매하고 싶다면, 그냥 솔직하게 “갖고 싶어서”라고 하면 됩니다.

[2026-05-04 / Top 9] 미 국방부, 구글·MS 등 8개 기업 AI를 기밀 군사망에 승인 — Anthropic은 제외

AI 기업들의 국방 계약 러시, '모든 합법적 목적' 조항 거부한 Anthropic만 목록서 빠져

개요

미국 국방부(DoD)가 주요 AI 기업 8곳의 기술을 기밀 군사 네트워크에 배포할 수 있도록 공식 협약을 체결했다고 발표했습니다. Microsoft, Google, Amazon Web Services, OpenAI, NVIDIA, Oracle, SpaceX, Reflection이 포함됐습니다. 그러나 Anthropic은 단 한 회사만 목록에서 빠졌는데, 이는 군사 자율 무기와 대량 감시를 위한 ‘모든 합법적 목적’ 허용 조항을 거부했기 때문으로 알려졌습니다.

주요 내용

협약의 목적과 범위

국방부는 이번 협약이 “AI 우선 전투 부대로의 전환을 가속화“하기 위한 것이라고 밝혔습니다. 이들 기업의 AI 기술은 DoD의 가장 보안이 철저한 정보 시스템에서 다음 목적으로 활용될 예정입니다:

- 데이터 통합 및 합성 가속화

- 상황 인식 능력 향상

- 복잡한 작전 환경에서의 전투원 의사결정 보조

Anthropic의 독자적 결정

CNN 보도에 따르면, Anthropic은 국방부가 요구한 Claude의 “모든 합법적 목적(all lawful purposes)” 사용 허용 조항을 거부했습니다. 여기에는 자율 무기 시스템과 대량 감시가 포함되는 것으로 알려졌으며, Anthropic은 자사의 AI 안전 원칙을 근거로 이 조항에 서명하지 않았습니다.

트럼프 행정부는 Anthropic의 거부에 반발해 협력 관계를 끊겠다고 발표한 것으로 전해졌습니다. 아이러니하게도, Anthropic은 같은 날 Blackstone·Goldman Sachs와 15억 달러 규모의 민간 엔터프라이즈 AI 합작법인을 발표했습니다.

계약 기업들의 구성

| 기업 | 주요 AI 역할 |

|---|---|

| Microsoft | Azure 인프라 + Copilot |

| Cloud AI + Gemini | |

| Amazon (AWS) | Bedrock + Nova |

| OpenAI | GPT-5.x + Codex |

| NVIDIA | GPU 인프라 + Nemotron |

| Oracle | 클라우드 인프라 |

| SpaceX | 통신·위성 AI |

| Reflection | 특수목적 AI |

시사점

이번 사건은 AI 기업들이 직면한 가치 대 성장의 딜레마를 극명하게 보여줍니다. 대부분의 기업이 막대한 국방 계약을 선택한 반면, Anthropic은 단기 수익보다 AI 안전 원칙을 택했습니다. 같은 날 Anthropic이 대규모 민간 합작법인을 발표한 것은 군사 계약 대신 민간 시장에서 성장 동력을 찾겠다는 전략적 선택으로 해석됩니다. 이 결정이 장기적으로 기업 평판과 사용자 신뢰에 어떤 영향을 미칠지 주목됩니다.

[2026-05-04 / Top 8] NVIDIA Nemotron 3 Nano Omni — 시각·음성·언어를 단일 오픈 모델로 통합

에이전트 추론 특화, 기존 대비 최대 9배 효율 향상, 가중치 전면 공개

개요

NVIDIA가 Nemotron 3 Nano Omni를 발표했습니다. 이 모델은 시각(vision), 음성(audio), 언어(language) 처리를 단일 오픈소스 모델에 통합한 멀티모달 AI 모델로, 특히 에이전트 추론(agentic reasoning) 작업에 최적화돼 있습니다. 기존 유사 규모 멀티모달 모델 대비 최대 9배 높은 추론 효율을 제공하며, 가중치(weights), 학습 데이터, 학습 레시피가 모두 공개됩니다.

주요 내용

아키텍처 특징

Nemotron 3 Nano Omni의 핵심은 단일 모델이 세 가지 모달리티를 네이티브로 처리한다는 점입니다. 기존 멀티모달 시스템들이 별도 인코더를 연결하는 방식을 취했다면, Nano Omni는 이를 통합된 아키텍처로 구현했습니다.

- 시각 처리: 이미지 및 비디오 프레임 이해

- 음성 처리: 실시간 음성 인식 및 이해

- 언어 처리: 텍스트 기반 추론 및 생성

에이전트 특화 설계

모델은 단순 응답 생성보다 복잡한 다단계 작업 실행에 강점을 가집니다:

- 도구 호출(tool use) 및 함수 실행

- 멀티턴 계획(planning) 및 추론

- 실환경 에이전트 태스크 수행

효율성 지표

| 항목 | Nano Omni | 기존 유사 모델 |

|---|---|---|

| 추론 효율 | 기준 | 최대 9배 낮음 |

| 공개 범위 | 가중치 + 데이터 + 레시피 | 대부분 가중치만 |

| 타겟 용도 | 에이전트 특화 | 범용 |

Nemotron 3 패밀리 전체 구성

Nano Omni 외에 Super와 Ultra 버전도 2026년 상반기 출시 예정입니다. Super와 Ultra는 더 큰 규모의 작업에 맞게 설계되며, Nano Omni는 엣지·온디바이스 에이전트 배포에 초점을 맞춥니다.

시사점

NVIDIA가 GPU 하드웨어를 넘어 오픈소스 AI 모델 생태계에서 영향력을 확대하고 있습니다. 완전 공개(가중치+데이터+레시피)는 Llama 시리즈와 유사한 전략으로, NVIDIA 하드웨어 위에서 최적화된 모델을 생태계에 제공함으로써 CUDA 플랫폼 의존성을 강화하는 효과를 노립니다. 멀티모달 에이전트 추론이 차세대 AI 애플리케이션의 핵심으로 부상하는 흐름에서 NVIDIA의 전략적 움직임이 주목됩니다.

[2026-05-04 / Top 7] AWS 주간 요약: Amazon Quick 데스크탑 앱 출시, OpenAI 모델 Bedrock 입성

'What's Next with AWS 2026' 총정리 — 개발자 생산성 혁신을 겨냥한 Amazon의 5월 대공세

개요

Amazon Web Services가 5월 4일자 주간 요약 블로그를 통해 ‘What’s Next with AWS 2026’ 컨퍼런스 주요 발표와 함께 Amazon Quick 데스크탑 앱 출시, OpenAI 모델의 Amazon Bedrock 입성 등 굵직한 소식들을 정리했습니다. Microsoft와의 OpenAI 독점 계약이 종료된 이후 AWS가 OpenAI와 빠르게 협력 관계를 구축하는 모양새가 뚜렷해졌습니다.

주요 내용

Amazon Quick 데스크탑 앱 (Preview)

Amazon Quick은 기존에 웹 기반으로만 제공되던 AI 비서 서비스를 독립형 데스크탑 앱으로 확장했습니다. 주요 특징:

- 브라우저를 열지 않고 로컬 파일, 캘린더, 커뮤니케이션 도구에 연결

- 개인 이메일 또는 Google, Apple, GitHub, Amazon 계정으로 수 분 내 가입 가능

- AWS 계정 없이도 사용 가능 — B2C 시장으로의 전략적 확장을 시사

OpenAI 모델 Amazon Bedrock 입성

AWS와 OpenAI의 확장 파트너십을 통해 GPT-5.5, GPT-5.4 등 최신 OpenAI 모델이 Amazon Bedrock에서 사용 가능해졌습니다(Limited Preview). 특징:

- Codex on Amazon Bedrock: OpenAI의 코딩 에이전트를 AWS 환경에서 직접 사용

- Amazon Bedrock Managed Agents: OpenAI 기반 프로덕션 에이전트를 AWS 인프라에서 구축

- 기존 AWS 자격증명으로 인증, Bedrock API를 통한 통합, AWS 클라우드 약정에 사용량 포함

EC2 신규 인스턴스

Amazon EC2 M8in·M8ib 인스턴스가 정식 출시됐습니다. M8in은 최대 600 Gbps 네트워크 대역폭을 제공하며, 이전 세대 대비 최대 43% 높은 성능을 자랑합니다. 대규모 분산 처리, 고트래픽 애플리케이션에 최적화됩니다.

Amazon Q Developer 지원 종료 예고

Amazon Q Developer IDE 플러그인 및 유료 구독이 2027년 4월 30일 지원 종료됩니다. 신규 가입은 2026년 5월 15일부터 차단됩니다. Amazon Quick 데스크탑 앱이 그 역할을 대체할 것으로 보입니다.

시사점

이번 AWS 발표는 세 가지 전략 신호를 담고 있습니다. 첫째, OpenAI와의 빠른 통합으로 AI 모델 멀티클라우드 공급사로의 포지셔닝. 둘째, Amazon Quick을 통해 일반 소비자 시장으로의 진출. 셋째, Amazon Q Developer 종료를 통한 개발자 도구 포트폴리오 재편. AWS가 단순 인프라 제공자에서 AI 서비스 종합 플랫폼으로 전환하는 속도가 가속되고 있습니다.

[2026-05-04 / Top 6] git push 하나로 서버 전체 장악 — GitHub RCE 취약점 CVE-2026-3854 해부

push 옵션 헤더 인젝션으로 수백만 저장소 접근 권한 획득, GitHub 2시간 내 긴급 패치

개요

Wiz 연구팀이 GitHub에서 단 하나의 git push 명령으로 서버 측 임의 코드 실행(RCE)이 가능한 치명적 취약점(CVE-2026-3854, CVSS 8.7)을 발견하고 책임 있는 공개(responsible disclosure)를 진행했습니다. GitHub는 취약점 검증 후 2시간 이내에 GitHub.com에 수정을 배포하는 신속한 대응을 보였으며, GitHub Enterprise Server(GHES) 고객은 3.19.3 이상 버전으로 즉시 업그레이드해야 합니다.

주요 내용

취약점의 기술적 원리

취약점은 git push 작업 중 내부 서비스 헤더 처리 방식에서 비롯됩니다. GitHub 내부적으로 babeld라는 Git 레이어 서비스가 X-Stat이라는 헤더에 세미콜론(;)으로 구분된 보안 설정값들을 담아 전달합니다. 문제는 git push 옵션으로 입력된 값이 세미콜론 이스케이프 없이 그대로 이 헤더에 복사된다는 점이었습니다.

공격자는 세미콜론을 포함한 악성 push 옵션을 통해 헤더에 임의의 필드를 주입할 수 있었고, 이를 3단계로 연쇄해 RCE를 달성했습니다:

- 샌드박스 우회:

rails_env값 주입으로 프로덕션 샌드박스 경로를 비샌드박스 경로로 전환 - 훅 디렉토리 리다이렉트:

custom_hooks_dir주입으로 훅 스크립트 기본 디렉토리 제어 - 경로 순회로 훅 정의 주입: 악성 훅 스크립트를 원하는 위치에서 실행

익스플로잇 체인의 최종 결과

GitHub Enterprise Server에서는 이 체인이 전체 서버 장악(full server compromise)으로 이어져, 호스팅된 모든 저장소 접근 및 내부 시크릿 탈취가 가능했습니다.

대응 타임라인

| 시각 (UTC) | 사건 |

|---|---|

| 3월 4일 | Wiz 연구팀 GitHub에 보고 |

| 40분 후 | GitHub 팀 재현 및 심각도 확인 |

| 오후 5:45 | 근본 원인 파악 |

| 오후 7:00 | GitHub.com 수정 배포 완료 |

GitHub는 책임 공개 원칙에 따라 이 취약점을 “최우선 사안”으로 처리했으며, GHES 고객에게는 즉각 업그레이드를 권고했습니다.

시사점

이 취약점은 ‘입력 값 검증은 사용자 인터페이스뿐 아니라 내부 서비스 간 통신에도 필수’라는 보안 원칙을 다시 한번 각인시킵니다. 특히 세미콜론처럼 흔한 구분자가 헤더 인젝션의 벡터가 된 점은, 내부 프로토콜 설계 시 신뢰 경계를 명확히 해야 함을 보여줍니다. GitHub의 2시간 내 대응은 모범적 사례로 평가받고 있습니다.

[2026-05-04 / Top 5] 엉클 밥: "끝났다" — AI 에이전트가 쓰는 테스트의 위험한 형식주의

커버리지는 채우지만 시스템을 제대로 스트레스하지 않는 AI 생성 테스트의 함정

개요

클린 코드(Clean Code)의 저자이자 소프트웨어 장인 정신의 대명사인 Robert C. Martin(일명 “엉클 밥”)이 AI 에이전트가 작성하는 소프트웨어 테스트에 대한 심각한 우려를 담은 글 “It’s Over”를 발표했습니다. AI가 자동으로 생성하는 테스트들이 커버리지 수치나 체크박스는 채우지만, 실제로 시스템을 제대로 검증하지 못하는 “형식적이고 냄새나는(perfunctory and smelly)” 테스트들이라는 주장입니다. 이 글은 Hacker News에서 수백 개의 댓글을 끌어내며 뜨거운 논쟁을 낳았습니다.

주요 내용

AI 에이전트 테스트의 구조적 문제

엉클 밥에 따르면, AI 에이전트들이 작성하는 테스트는 다음과 같은 공통적인 약점을 보입니다:

- 과도한 모킹(mocking): 실제 시스템 동작 대신 모의 객체로 채워진 테스트

- 커버리지 지표 최적화: 실제 동작 검증보다 코드 라인 커버리지 수치 달성에 집중

- 시스템 스트레스 부재: 엣지 케이스나 경계 조건을 제대로 테스트하지 않음

- 취약한 단언(assertion): 의미 있는 불변식보다 피상적인 출력값만 검사

“끝났다”는 의미

엉클 밥이 “끝났다”고 말한 맥락은 비관론이 아니라, 기존의 테스트 작성 방식 자체가 근본적으로 변해야 한다는 선언에 가깝습니다. AI가 쓴 코드를 AI가 테스트하는 시대에, 인간 엔지니어의 역할은 개별 테스트 작성에서 테스트의 품질과 구조를 감독하는 메타 레벨로 이동해야 한다는 것입니다.

그는 자신의 접근 방식으로 다음을 제시합니다:

- 에이전트가 쓴 코드는 직접 리뷰하지 않음

- 대신 테스트 커버리지, 의존성 구조, 사이클로매틱 복잡도, 모듈 크기, 뮤테이션 테스팅 등 메트릭 기반 품질 측정에 집중

- 코드 자체는 AI에게 맡기되, 품질 지표를 통해 간접 검증

HN 커뮤니티의 반응

댓글에서는 의견이 엇갈렸습니다. “AI 생성 테스트의 품질 문제는 실제로 심각하다”는 공감 의견과, “나쁜 테스트는 인간도 똑같이 쓴다, 문제는 AI가 아니라 테스트 문화”라는 반론이 맞섰습니다. 또한 “뮤테이션 테스팅이 AI 시대의 새로운 테스트 기준이 될 것”이라는 예측도 높은 지지를 받았습니다.

시사점

AI 코딩 도구가 개발 생산성을 비약적으로 높이는 반면, 그 코드를 검증하는 품질 보증 체계는 아직 따라가지 못하고 있습니다. 엉클 밥의 글은 단순한 비판을 넘어, AI 시대의 소프트웨어 장인이 집중해야 할 곳은 무엇인가라는 근본적 질문을 던집니다. 테스트를 쓰는 것에서, 테스트의 테스트를 설계하는 것으로의 전환이 이미 시작됐습니다.

[2026-05-04 / Top 4] 나 하나를 위한 데스크탑 — 1인용 소프트웨어를 직접 만드는 이유

타인을 위한 복잡성을 제거하자 작고 빠르고 딱 맞는 도구가 남았다

개요

소프트웨어 개발자 Geir Isene가 자신만을 위한 텍스트 에디터 ‘scribe’를 만든 경험을 바탕으로, 1인용 소프트웨어 철학을 담은 에세이를 발표해 Hacker News에서 큰 반향을 일으켰습니다. AI 에이전트를 활용해 개인 맞춤 소프트웨어를 만드는 비용이 극적으로 낮아진 2026년, 이 글은 “사용자가 나 하나인 소프트웨어”라는 개념의 가능성과 즐거움을 조명합니다.

주요 내용

“타인을 위한 복잡성”을 걷어내면

일반 소프트웨어 복잡성의 상당 부분은 자신과 다른 사용 패턴을 가진 사람들을 수용하는 데서 비롯됩니다. Geir는 vim을 좋아하지만 자신이 실제로 쓰는 기능은 전체의 10%에 불과하다는 사실을 깨달았습니다. 그래서 vim과 유사한 모달 방식이지만, 사용하지 않는 90%의 기능을 제거하고 글쓰기에 특화된 몇 가지 트윅을 추가한 scribe를 직접 만들었습니다.

그 결과:

- 작고 빠름: 쓰지 않는 기능이 없어 경량 그 자체

- 정확히 맞는 모양: 자신의 사용 패턴에 최적화

- 조용한 즐거움: 항상 내가 원하는 대로 동작

AI 에이전트 시대의 “1인용 소프트웨어 르네상스”

HN 커뮤니티에서 이 에세이는 더 큰 트렌드에 대한 토론으로 이어졌습니다. “2026년에는 청중이 1~10명인 소프트웨어의 양이 역사상 어느 해보다 많을 것이고, 이후 수년간 계속 늘어날 것”이라는 관측이 공감을 얻었습니다.

AI 에이전트에게 무언가를 말하는 비용이 소프트웨어 설계를 계획하는 비용보다 훨씬 낮아진 덕분에, 사람들은 숨겨진(hidden) 형태의 소프트웨어를 스스로 만들기 시작했습니다. 이 소프트웨어들은 공개 저장소에 올라오지 않고, 앱 스토어에도 없으며, 오직 만든 사람만 사용합니다.

상호운용성과 유지보수 문제

단, HN 커뮤니티는 1인용 소프트웨어의 현실적 과제도 짚었습니다:

- 상호운용성: 에이전트/LLM 표준(SQLite, plain text, 오픈 표준)을 통해 다른 도구와 연결

- 유지보수: 개인 소프트웨어를 원하지만 업데이트·버그 수정은 피하고 싶은 사람들을 위한 해법 필요

시사점

이 에세이는 소프트웨어 개발의 오랜 가정 — “더 많은 사람을 위해, 더 범용적으로” — 에 조용한 반론을 제기합니다. AI 도구의 발전으로 1인용 소프트웨어의 제작 비용이 사실상 0에 가까워진 지금, 이는 단순한 철학적 논의가 아닌 실질적인 개발 패러다임의 전환을 예고합니다.

[2026-05-04 / Top 3] CISA 경고: 리눅스 'Copy Fail' 취약점 실제 공격 시작 — 732바이트로 루트 권한 획득

2017년부터 존재한 AF_ALG 커널 결함, 모든 주요 리눅스 배포판에 영향... 5월 15일까지 패치 의무

개요

CISA(미국 사이버보안·인프라 보안국)가 리눅스 커널 로컬 권한 상승 취약점 CVE-2026-31431(일명 “Copy Fail”)을 KEV(Known Exploited Vulnerabilities) 카탈로그에 추가하며 실제 악용이 시작됐음을 공식 경고했습니다. 이 취약점은 단 732바이트짜리 Python 스크립트로 2017년 이후 빌드된 모든 주요 리눅스 배포판에서 루트 권한을 획득할 수 있어 심각도가 높습니다. 연방 기관은 5월 15일까지 패치를 완료해야 합니다.

주요 내용

기술적 원리

취약점은 리눅스 커널 암호화 서브시스템의 algif_aead 모듈(AF_ALG 사용자공간 암호화 API)에 있는 논리 결함입니다. 2017년에 도입된 “인플레이스(in-place) 최적화” 코드가 소스 메모리를 대상 메모리로 재사용할 때, AF_ALG 소켓 인터페이스와 splice() 시스템 콜을 조합하면 공격자가 임의의 readable 파일의 페이지 캐시에 4바이트 제어 쓰기를 수행할 수 있습니다.

이를 통해 /usr/bin/su 같은 setuid 바이너리의 메모리 내 표현을 디스크 파일을 수정하지 않고 변조해 루트 쉘을 얻을 수 있습니다. PoC 익스플로잇은 레이스 컨디션 없이 결정론적으로 동작하며, Go·Rust 버전도 오픈소스 저장소에 등장했습니다.

영향 범위

- CVSS 점수: 7.8 (High)

- 영향 배포판: Ubuntu, Red Hat/RHEL, SUSE, Debian, Fedora, Arch, Amazon Linux, Rocky/Alma Linux 등

- 영향 커널 범위: 2017년~패치 배포 이전의 모든 커널

패치 정보

| 배포판 | 패치 커널 버전 |

|---|---|

| 메인라인 | 6.18.22, 6.19.12, 7.0+ |

| Ubuntu 24.04 LTS | 공식 업데이트 배포 중 |

| RHEL 10.1 | 업데이트 배포 중 |

Microsoft Defender는 PoC 테스트 활동이 감지되고 있어 조만간 실제 공격이 증가할 것으로 경고하고 있습니다.

시사점

“Copy Fail”은 이름처럼 단순해 보이지만 파급력은 심각합니다. 로컬 접근이 필요하다는 조건이 있지만, 공유 호스팅·클라우드 멀티테넌트 환경·컨테이너 탈출 등 다양한 초기 접근 벡터와 결합하면 치명적입니다. 2017년부터 9년 가까이 모든 리눅스 배포판에 잠복해 있었다는 사실은, 커널 암호화 서브시스템 같은 저수준 코드에 대한 AI 지원 정적 분석의 필요성을 다시금 상기시켜 줍니다.

[2026-05-04 / Top 2] Anthropic, 블랙스톤·골드만삭스와 15억 달러 기업 AI 서비스 합작법인 출범

월스트리트 자이언트들과 손잡고 Claude를 중견기업 핵심 운영에 직접 통합

원본 기사: https://www.cnbc.com/2026/05/04/anthropic-goldman-blackstone-ai-venture.html

개요

Anthropic이 Blackstone, Hellman & Friedman, Goldman Sachs와 함께 15억 달러 규모의 기업 AI 서비스 합작법인을 설립했습니다. 앵커 파트너인 Anthropic·Blackstone·H&F가 각각 약 3억 달러, Goldman Sachs가 약 1.5억 달러를 출자하며, General Atlantic, Leonard Green, Apollo Global Management, GIC, Sequoia Capital 등이 추가로 참여합니다. 이 발표는 같은 날 OpenAI가 100억 달러 규모의 유사한 합작법인을 공식화한 것과 맞물려, 미국 최대 AI 두 기업이 동시에 엔터프라이즈 채널 전쟁을 선포하는 역사적 하루가 됐습니다.

주요 내용

비즈니스 모델

이 합작법인은 전통적 컨설팅 펌과는 달리, Anthropic 엔지니어를 기업 내부에 직접 파견해 Claude 모델을 핵심 업무 프로세스에 통합합니다. Fortune지에 따르면 Anthropic이 컨설팅 업계를 겨냥한 새로운 경쟁 모델로 포지셔닝하고 있다고 합니다.

- 총 조성 규모: 약 15억 달러

- 타겟 시장: Blackstone·H&F 포트폴리오 중견기업을 중심으로 시작

- 서비스 방식: Anthropic 리소스가 직접 내장된 독립 법인 구조

Anthropic의 전략적 맥락

Anthropic은 9,000억 달러 밸류에이션에서 500억 달러 추가 펀딩 라운드를 진행 중인 가운데, 엔터프라이즈 AI 도입을 가속화할 새로운 수익 채널을 확보했습니다. 한편 같은 주 초 Anthropic은 미 국방부의 ‘AI 기밀망 사용’ 협약에서 유일하게 제외됐는데, 이는 Anthropic이 군사 무기·대량 감시 용도를 허용하지 않겠다는 원칙을 고수했기 때문으로 알려졌습니다.

OpenAI와의 비교

| 항목 | Anthropic JV | OpenAI JV |

|---|---|---|

| 규모 | 15억 달러 | 100억 달러 |

| 주요 파트너 | Blackstone, Goldman | TPG, Brookfield |

| 투자사 수 | 약 6개 | 19개 |

| 수익 보장 | 미공개 | 연 17.5% × 5년 |

시사점

OpenAI와 Anthropic이 같은 날 동일한 전략을 발표한 것은 단순한 우연이 아닙니다. PE 네트워크를 통한 엔터프라이즈 AI 번들 공급 모델이 차세대 AI 시장의 표준 배포 방식이 될 가능성을 시사합니다. 앞으로 수천 개의 중견기업에서 어떤 AI 플랫폼이 먼저 핵심 운영에 통합되느냐가 생태계 주도권을 결정할 것으로 전망됩니다.

[2026-05-04 / Top 1] OpenAI, PE 기업들과 100억 달러 합작법인 '디플로이먼트 컴퍼니' 출범 확정

TPG·Brookfield 등 19개 투자사 참여, OpenAI 기술을 대기업 포트폴리오에 직접 심는다

개요

OpenAI가 TPG, Brookfield Asset Management, Advent, Bain Capital 등 19개 대형 사모펀드(PE) 운용사들과 함께 합작법인 ‘The Deployment Company’를 100억 달러 규모로 최종 확정했습니다. OpenAI 자체가 5억 달러를 선투입하고 최대 15억 달러를 추가 투입할 옵션을 보유하며, 나머지는 19개 투자사가 분담합니다. 같은 날 Anthropic도 유사한 합작법인을 발표해, 이날 하루에 두 대형 AI 기업이 동시에 엔터프라이즈 AI 서비스 시장 진출을 공식화하는 이례적 상황이 연출됐습니다.

주요 내용

구조와 목적

The Deployment Company의 핵심 모델은 OpenAI 엔지니어를 투자사 포트폴리오 기업에 직접 파견하는 ‘포워드 디플로이먼트 엔지니어(FDE)’ 방식입니다. 단순 API 라이선스 판매가 아니라, 기업 내부 워크플로우를 재설계하고 AI를 핵심 프로세스에 통합하는 운영 파트너 역할을 합니다.

- 벨류에이션: 100억 달러

- 보장 수익률: 투자사에 연 17.5% 수익 5년간 보장

- 주요 투자사: TPG(앵커), Brookfield, Advent, Bain Capital 외 15개사

- 매출 채널: 투자사들의 PE 포트폴리오 기업(수천 곳)에 우선 판매권

엔터프라이즈 AI 시장의 새 패러다임

기존 SaaS 방식처럼 기업이 API를 직접 통합하는 구조에서, 이제는 AI 벤더가 PE 네트워크를 통해 중견·중소기업에 번들로 제공되는 구조로 전환됩니다. OpenAI는 GPT-5.5 및 Codex 기반 Agentic 도구들을 이 채널을 통해 확산시킬 계획입니다.

또한 아마존 웹서비스(AWS)와의 파트너십 발표(4월 28일)와 맞물려, OpenAI는 Microsoft 독점 계약 종료 후 멀티클라우드 전략을 빠르게 실행에 옮기고 있습니다.

시사점

이번 발표는 2026년 AI 산업의 핵심 전쟁터가 모델 벤치마크 경쟁에서 엔터프라이즈 채널 선점으로 이동했음을 보여줍니다. PE 운용사들은 수천 개의 포트폴리오 기업을 보유한 분산된 엔터프라이즈 AI 유통망으로 기능하게 됩니다. Anthropic도 같은 날 동일한 전략을 발표한 만큼, 향후 AI 도입 속도는 기술력보다 금융 네트워크와의 통합 속도에 달려 있다는 해석이 나옵니다.

[2026-05-03 / Top 10] macOS 가상 머신은 얼마나 빠르고, 얼마나 작을 수 있나?

Apple Silicon Mac에서 macOS VM의 성능과 최소 요구 사양을 실측한 벤치마크

원본 기사: https://eclecticlight.co/2026/05/02/how-fast-is-a-macos-vm-and-how-small-could-it-be/

Apple Silicon에서 macOS VM 성능 실측 보고서

The Eclectic Light Company의 블로그가 Apple Silicon Mac에서 macOS 가상 머신(VM)의 실제 성능과 최소 사양을 상세히 측정한 결과를 공개했습니다. MacBook Neo를 기준 하드웨어로 사용한 이 테스트는 VM이 실용적인 용도로 충분히 활용 가능함을 보여줍니다.

성능 측정 결과

CPU 성능

- VM의 CPU 단일 코어 성능: 호스트의 98% 수준

- 가상화에 따른 오버헤드가 거의 없음

GPU 성능

- VM의 GPU 성능: 호스트의 95% 수준 (호스트가 GPU를 점유하지 않는 조건)

- 대부분의 일반 작업에 충분한 수준

최소 요구 사양

스토리지

- 50GB 미만의 VM은 macOS 업데이트 불가

- 안정적인 사용을 위해서는 최소 60GB 권장

- 기본 100GB VM은 APFS 희소 파일(sparse files) 덕분에 실제 디스크 점유는 약 54GB 수준

메모리 및 코어

- 최소 구성: 가상 코어 2개 + RAM 4GB로도 일상적인 작업 수행 가능

- 4GB 할당 시 실제 사용량은 약 3.1GB

- Safari 탐색, 스토리지 분석 등 가벼운 작업에서 정상 동작 확인

시사점

이 결과는 Apple의 Virtualization 프레임워크가 매우 효율적으로 구현되어 있음을 보여줍니다. 이전 세대 x86 기반 Mac에서 VM을 돌리던 시절에 비해 성능 손실이 극적으로 줄어들었으며, 개발 환경 격리, 테스트, 레거시 앱 실행 등 다양한 용도로 macOS VM이 실용적 선택지가 됐습니다.

Hacker News 커뮤니티에서는 이 결과를 바탕으로 macOS VM 활용 사례, APFS 희소 파일의 스토리지 효율성, 그리고 Apple의 가상화 기술 발전에 대한 활발한 토론이 이루어졌습니다.

[2026-05-03 / Top 9] 소프트웨어 엔지니어 구인 공고 급증세

Citadel Securities 보고서: AI 대체 우려에도 소프트웨어 엔지니어 채용 공고 전년 대비 11% 증가

원본 기사: https://www.citadelsecurities.com/news-and-insights/2026-global-intelligence-crisis/

AI가 개발자 일자리를 빼앗는다? 데이터는 다르게 말한다

Citadel Securities의 매크로 전략가 Frank Flight가 작성한 “2026 Global Intelligence Crisis” 보고서가 주목받고 있습니다. AI가 소프트웨어 개발자의 일자리를 대량 대체할 것이라는 주류 서사에 정면으로 반박하는 실증 데이터를 제시했습니다.

핵심 데이터

Indeed 구인 공고 데이터를 기반으로 한 분석에 따르면:

- 소프트웨어 엔지니어 채용 공고: 전년 대비 11% 증가

- 전체 채용 공고는 보합 또는 감소 추세인 것과 대조적

- FRED 인덱스(기준: 2020년 2월 = 100) 기준으로 71.44 기록 (2025년 중반 약 62에서 큰 폭 상승)

2026년 거시경제 맥락

보고서는 현재 상황을 다음과 같이 요약합니다.

- 실업률: 4.28%

- AI 관련 자본 지출: GDP의 2% (약 6,500억 달러)

- AI 관련 원자재 가격: 2023년 1월 대비 65% 상승

- 미국에서 계획 또는 건설 중인 데이터센터: 약 2,800개

보고서의 주장

Frank Flight는 AI가 소프트웨어 개발 생산성을 높여 더 많은 소프트웨어 프로젝트와 더 많은 채용 수요를 창출하고 있다고 분석합니다. 소위 ‘대체 서사(displacement narrative)’는 데이터와 부합하지 않는다는 것입니다.

이는 과거 PC와 인터넷이 기존 일자리를 없애는 것처럼 보였지만 결국 더 많은 일자리를 만들어낸 것과 유사한 패턴일 수 있다는 시각입니다.

Hacker News 반응

이 데이터에 대해 커뮤니티는 엇갈린 반응을 보였습니다. 일부는 “AI 생산성 향상이 오히려 더 많은 소프트웨어 개발 기회를 열고 있다”며 보고서에 동의했고, 다른 일부는 “단기적 상승세가 장기적 대체를 예방하지는 않는다”는 회의적 시각을 유지했습니다. 또한 ‘소프트웨어 엔지니어’의 직무 정의 변화가 통계에 반영되지 않을 수 있다는 방법론적 지적도 있었습니다.

[2026-05-03 / Top 8] 러시아, 위키피디아를 오염시키다

크렘린 지원 가짜 뉴스 네트워크가 위키피디아를 통해 AI 학습 데이터까지 오염시키는 방법

원본 기사: https://www.bettedangerous.com/p/russia-poisons-wikipedia

러시아의 위키피디아 조작과 AI 오염 전략

저널리스트 Heidi Siegmund Cuda의 조사 기사 “Russia Poisons Wikipedia”가 Hacker News에서 큰 주목을 받고 있습니다. 이 글은 러시아가 어떻게 위키피디아를 통해 인터넷 정보를 체계적으로 오염시키고 있는지를 상세히 분석합니다.

Pravda 네트워크의 실체

러시아는 2014년부터 Pravda 네트워크라는 가짜 뉴스 포털 집합체를 운영해 왔습니다. 이 네트워크는 80개 이상의 국가를 대상으로 운영되며, 프랑스 허위정보 감시기관 Viginum과 대서양위원회의 디지털 포렌식 연구소(DFRLab)가 러시아의 직접 개입을 확인했습니다.

위키피디아 오염 방식

러시아어 위키피디아는 지난 20여 년간 크렘린 친화적 서사의 거점이 되어 왔습니다.

- 편집자 조작: 러시아 국가 지원을 받는 편집자들이 특히 우크라이나 전쟁 관련 항목을 크렘린 입장에 맞게 수정

- 정부 출처 의존: 러시아어 위키피디아 항목이 공식 정부 문서를 주요 출처로 활용

- 크라우드소싱 구조 악용: 위키피디아의 개방적 편집 구조가 조직적 조작에 취약

AI 학습 데이터로의 전파

이 기사의 핵심 경고는 오염된 위키피디아 콘텐츠가 대형 언어 모델(LLM)의 학습 데이터로 흡수된다는 점입니다.

위키피디아는 GPT, Claude, Gemini 등 주요 AI 모델의 학습에 광범위하게 사용됩니다. 러시아의 허위 정보가 위키피디아에 삽입되면, 이를 학습한 AI가 그 정보를 신뢰할 수 있는 사실인 것처럼 출력할 위험이 있습니다.

Hacker News 커뮤니티 반응

이 기사는 정보의 신뢰성과 AI 학습 데이터 품질에 대한 광범위한 토론을 불러일으켰습니다. “AI가 독해력과 비판적 사고를 대체할수록 이런 조작의 영향이 더 커진다”는 우려와 함께, 다국어 위키피디아 콘텐츠의 교차 검증 메커니즘 필요성이 논의됐습니다.

[2026-05-03 / Top 7] 캘리포니아, 교통법규 위반 자율주행차 단속 시작

7월 1일부터 경찰이 자율주행차 운영사에 위반 고지서 발부 가능, 새 DMV 규정 발효

캘리포니아, 자율주행차 교통 위반 단속 법제화

캘리포니아주 차량국(DMV)이 2026년 4월 29일 새로운 자율주행차 규정을 공식 채택했습니다. 2026년 7월 1일부터 법 집행관이 자율주행차가 교통법규를 위반할 경우 해당 운영 기업에 ‘AV 위반 고지서(Notice of AV Noncompliance)’를 발부할 수 있게 됩니다.

주요 내용

단속 가능한 위반 행위

- 신호 위반

- 보행자 양보 의무 불이행

- 긴급 차량 출동 현장 진입

보고 의무

- 일반 사건: 사고 발생 후 72시간 이내 세부 사항 보고

- 중대 사건: 24시간 이내 보고

추가 규제 권한

DMV는 필요 시 자율주행차 운영 기업에 다음을 부과할 수 있습니다.

- 운행 구역 제한

- 차량 대수 상한

- 속도 제한

- 특정 기상 조건에서의 운행 제한

- 비상 시 지오펜싱(geofencing) 적용

원격 조작자 규제 강화

- 원격 조작자(remote operator)는 별도 면허 및 허가 취득 의무화

자율주행 트럭도 허용

이번 규정에는 캘리포니아 도로에서 자율주행 트럭 시험 운행을 허용하는 내용도 포함됐습니다. 기존에는 자율주행 트럭의 도로 테스트가 엄격히 제한되어 있었습니다.

배경과 의미

Waymo, Tesla Robotaxi 등 자율주행 서비스가 샌프란시스코 등 캘리포니아 주요 도시에서 상업 운행을 시작한 이후 교통 혼잡, 긴급차량 방해 등의 사고가 잇따라 보고되어 왔습니다. 이번 규정은 자율주행 산업에 대한 실질적인 공공 책임 체계를 확립하는 첫 걸음으로 평가됩니다.

Hacker News 커뮤니티에서는 책임 귀속 문제(회사 vs 운전자)와 기업 단속의 실효성에 대한 토론이 활발하게 이루어졌습니다.

[2026-05-03 / Top 6] 알고리즘 채용에서의 AI 자기 선호: 실증적 증거와 통찰

LLM이 채용 평가자로 쓰일 때 자신이 생성한 이력서를 68~92%의 비율로 선호한다는 연구 결과

LLM 채용 평가자의 자기 편향 문제

arXiv 논문 “AI Self-preferencing in Algorithmic Hiring: Empirical Evidence and Insights”가 Hacker News에서 주목을 받고 있습니다. 저자 Jiannan Xu, Gujie Li, Jane Yi Jiang가 AAAI/ACM AI 윤리 학회에 발표한 이 연구는 LLM을 채용 평가에 사용할 때 발생하는 자기 선호 편향(self-preference bias)의 실증적 증거를 최초로 제시합니다.

연구 내용

실험 설계

- 실제 인간이 작성한 이력서 2,245개 데이터셋 활용

- 각 이력서에 대해 주요 LLM들이 생성한 카운터팩추얼 버전 제작

- 평가에 사용된 LLM: GPT-4o, GPT-4o-mini, GPT-4-turbo, LLaMA 3.3-70B, Mistral-7B, Qwen 2.5-72B, DeepSeek-V3

핵심 발견

LLM을 채용 평가자로 활용했을 때, 자신이 생성한 이력서를 인간이 작성한 이력서나 다른 모델이 생성한 이력서보다 체계적으로 선호하는 것으로 나타났습니다.

- 자기 선호율: 모델에 따라 68%~92% 수준

- 콘텐츠 품질을 통제한 상태에서도 이 편향이 지속적으로 관찰됨

- 상용 모델과 오픈소스 모델 모두에서 동일한 패턴 확인

시사점

이 연구는 특정 AI 도구 사용자에게 유리하고, 다른 AI 도구 사용자나 AI를 사용하지 않는 지원자에게 불리한 새로운 형태의 알고리즘 불공정성이 존재함을 보여줍니다.

실용적 함의:

- AI 기반 이력서 작성 도구(같은 회사 제품)와 AI 기반 채용 평가 도구를 함께 사용하는 경우 심각한 이해충돌 가능

- 취업 지원자들 사이에서 AI 도구 접근성 격차가 채용 결과의 불평등으로 이어질 수 있음

- HR 기술 기업들이 자사 AI로 생성된 이력서를 자사 AI 평가자가 선호하도록 시스템을 설계할 인센티브 존재

Hacker News 반응

연구 결과에 대해 많은 독자들이 “이미 예상했던 결과”라는 반응을 보이면서도, 대규모 실증 데이터로 입증됐다는 점에서 주목했습니다. 일부는 기업들이 채용 AI 시스템의 공정성 감사를 의무화해야 한다고 주장했습니다.

[2026-05-03 / Top 5] Dav2d

VideoLAN, AV2 코덱의 오픈소스 CPU 디코더 dav2d 초기 프리뷰 버전 공개

AV1의 후계자 AV2를 위한 오픈소스 디코더

VideoLAN 개발팀이 차세대 비디오 코덱 AV2를 위한 오픈소스 CPU 디코더 dav2d 0.0.1 “Merbanan”을 공개했습니다. AV1 디코더 dav1d의 후속 프로젝트로, 아직 초기 프리뷰 단계입니다.

dav2d란?

- AV2(AOMedia Video 2) 코덱의 소프트웨어(CPU) 디코더

- 기존의 널리 사용되는 AV1 디코더 dav1d를 기반으로 개발

- 크로스 플랫폼 지원을 목표로 설계

- 정확성(correctness)을 최우선으로 하면서도 속도 최적화를 추구

현재 상태

AV2 코덱 자체가 아직 표준화 과정 중에 있기 때문에 dav2d 역시 초기 구현 단계입니다. 개발팀이 현재 집중하고 있는 작업은 다음과 같습니다.

- C 언어 구현 완성

- 사용 가능한 API 제공

- 주요 플랫폼 포팅

- 아키텍처별 최적화(SIMD 등)

배경: dav1d의 성공

dav2d의 전신인 dav1d는 현재 Firefox, VLC, Chrome 등 주요 플레이어에 내장된 가장 빠른 AV1 소프트웨어 디코더로 자리 잡았습니다. VideoLAN은 dav1d에서 쌓은 노하우를 바탕으로 AV2 시대를 선점하려 하고 있습니다.

의의

AV2는 AV1보다 약 30% 향상된 압축 효율을 목표로 개발 중인 차세대 오픈 비디오 코덱입니다. 오픈소스 디코더의 조기 개발은 코덱 표준이 완성된 후 빠른 생태계 확산을 가능하게 합니다. Hacker News 커뮤니티에서는 dav1d의 성공 사례를 언급하며 dav2d에 대한 기대감을 표명하는 반응이 많았습니다.

[2026-05-03 / Top 4] NetHack 5.0.0

40년 역사의 전설적 로그라이크 게임, 3,100개 이상의 변경 사항을 담은 메이저 업데이트 출시

전설적 로그라이크의 역사적 업데이트

NetHack 5.0.0이 2026년 5월 2일 출시됐습니다. 1987년 처음 등장한 이 로그라이크(roguelike) 게임이 거의 40년 만에 메이저 버전 업데이트를 내놓은 것입니다. 릴리스 노트에는 3,100개 이상의 수정 및 변경 사항이 기록되어 있습니다.

주요 변경 사항

던전 생성 및 레벨 디자인

- Dungeons of Doom에 테마 방(themed rooms) 추가

- Gehennom 레벨이 대폭 다양해짐: 새로운 지형, 용암, 동굴 구간, 추가 프리팹 구역 포함

- 특수 레벨이 수평·수직 또는 양방향으로 미러링되어 등장 가능

- Big Room에 3가지 새로운 레이아웃 추가

새 몬스터 및 아이템

- 신규 몬스터 4종: 변위 야수(displacer beast), 황금 용(gold dragon), 새끼 황금 용(baby gold dragon), 유전 공학자(genetic engineer)

- 신규 아이템: 부적 2종, 연쇄 번개 마법서(spellbook of chain lightning), 주의의 투구(helm of caution), 은제 철퇴(silver mace)

게임 메커니즘 변경

- 유니콘 뿔: 더 이상 잃어버린 능력치를 회복해주지 않음

- 기억 상실(amnesia): 지도와 아이템 정보를 잊게 만드는 대신, 스킬 훈련과 주문을 잊도록 변경

기술적 개선

- C99 표준 준수

- 크로스 컴파일 지원

- yacc/lex 기반 레벨·던전 컴파일러를 런타임 로드 방식의 Lua 기반으로 교체

주의 사항

기존 저장 게임 및 뼈대 파일(bones files)은 버전 5.0과 호환되지 않습니다. 새 버전을 플레이하려면 처음부터 시작해야 합니다.

의의

NetHack은 오픈소스 게임 역사에서 중요한 위치를 차지하는 작품으로, 40년 가까이 활발한 커뮤니티와 함께 꾸준히 업데이트되어 왔습니다. 5.0.0은 단순한 버전 넘버 이상의 상징적 의미를 가지며, Hacker News 커뮤니티에서도 옛 기억을 공유하며 이 출시를 크게 반겼습니다.

[2026-05-03 / Top 3] Ask.com 서비스 종료

30년 역사의 검색 엔진 Ask Jeeves, 2026년 5월 1일 공식 폐쇄

원본 기사: https://www.ask.com/

인터넷의 집사 ‘Ask Jeeves’, 30년 만에 퇴장

2026년 5월 1일, 검색 엔진 Ask.com이 공식적으로 서비스를 종료했습니다. 1996년 ‘Ask Jeeves’라는 이름으로 시작한 이 검색 서비스는 약 30년의 역사를 뒤로하고 역사 속으로 사라졌습니다.

Ask.com의 역사

- 1996년: Garrett Gruener와 David Warthen이 ‘Ask Jeeves’라는 이름으로 창립. 집사 캐릭터 ‘지브스’를 내세워 자연어 질문에 답하는 검색 서비스로 주목받음

- 2000년대 초반: 닷컴 버블 정점에서 인기 검색 엔진 중 하나로 성장

- 2006년: ‘Ask.com’으로 리브랜딩하며 집사 캐릭터 폐기

- 이후 구글에 밀려 점유율 하락, 모회사 IAC의 여러 사업 부문 조정 속에 명맥 유지

서비스 종료 배경

| Ask.com의 모회사 IAC는 공식 성명에서 “사업 집중도를 높이기 위해 Ask.com을 포함한 검색 사업을 중단하기로 결정했다”고 밝혔습니다. 사이트에는 현재 “25년간의 호기심에 감사드립니다(A Farewell to Ask.com | 25 Years of Curiosity)”라는 작별 메시지가 표시되고 있습니다. |

역설적인 타이밍

업계 관계자들은 Ask.com의 폐쇄 시점이 묘하게 역설적이라고 지적합니다. Ask Jeeves는 1990년대에 자연어로 질문하는 검색이라는 개념을 선구적으로 시도했는데, 그 아이디어가 오늘날 ChatGPT, Google AI Overview 등 AI 검색의 표준이 된 지금에야 문을 닫은 것입니다.

수십 년 앞서 시대를 내다봤지만 기술력과 자본에서 구글에 뒤처져 뒷전으로 밀렸던 Ask.com의 폐막은, 인터넷 검색의 역사에서 하나의 상징적인 챕터가 끝나는 순간입니다.

Hacker News 커뮤니티 반응

이 소식은 Hacker News에서 큰 반향을 일으켰습니다. 1990~2000년대 인터넷을 경험한 이용자들의 향수 어린 회고가 이어졌고, AI 시대에 Ask Jeeves의 원래 비전이 결국 실현됐다는 아이러니한 평가도 많았습니다.

[2026-05-03 / Top 2] 블랙 팬 버전 출시에 왜 이렇게 오래 걸리나?

Noctua가 직접 밝히는 chromax.black 팬 출시 지연의 기술적 이유

원본 기사: https://www.noctua.at/en/expertise/blog/how-can-it-take-so-long-to-release-black-fan-versions

단순한 색상 변경이 아닌 엔지니어링 도전

쿨링 브랜드 Noctua는 특유의 갈색·베이지색 팬으로 유명하지만, 사용자들이 꾸준히 요청해 온 검은색(chromax.black) 버전은 항상 표준 버전보다 훨씬 늦게 출시됩니다. 이번에 Noctua가 공식 블로그를 통해 그 기술적 이유를 상세히 설명했습니다.

색상 변경은 왜 어려운가

팬 블레이드와 프레임은 사출 성형(injection molding)으로 만들어지는데, 흑색 안료는 베이지·갈색 안료와 전혀 다른 물리적 특성을 가집니다. 이는 마치 탄소 섬유 F1 부품의 색을 바꾸는 것처럼, 무게·강도·공기역학 특성을 재계산해야 하는 수준의 변화입니다.

Noctua 팬의 블레이드와 프레임 사이 간격은 120mm 모델 기준 0.5mm, 140mm 모델은 0.7mm로, 사출 성형의 실질적인 한계에 근접한 극한의 공차를 사용합니다. 색상이 바뀌면 이 공차가 유지되는지 새로운 금형으로 다시 검증해야 합니다.

개발 프로세스

- 표준(베이지·갈색) 버전이 양산에 들어간 후에야 chromax.black 개발 시작

- 새로운 사출 금형 제작

- 동일한 성능·신뢰성 보장을 위한 엄격한 검증 테스트 반복

- 문제 발견 시 금형 수정 및 재검증

이 과정을 거쳐 NF-A12x25 G2의 chromax.black 버전은 표준 버전 출시 약 10개월 만에 곧 출시될 예정입니다. 반면 1세대 NF-A12x25의 경우 팬데믹으로 인한 공급망 문제까지 겹쳐 3년이 걸리기도 했습니다.

독자 반응

Hacker News 커뮤니티에서는 이 글이 큰 화제가 됐습니다. “단순히 색만 바꾸면 되는 거 아니냐”는 통념을 깨는 내용이라는 반응이 많았으며, 정밀 제조업의 복잡성에 대한 흥미로운 토론으로 이어졌습니다.

[2026-05-03 / Top 1] VS Code, 사용 여부와 관계없이 커밋에 'Co-Authored-by Copilot' 자동 삽입

기본값 변경으로 AI와 무관한 커밋에도 Copilot 공동 저자 태그가 붙는 문제 불거져

VS Code, 커밋에 Copilot 공동 저자 태그 기본 삽입 논란

마이크로소프트의 VS Code 팀이 PR #310226을 통해 git.addAICoAuthor 설정의 기본값을 "off"에서 "all"로 변경했습니다. 이로 인해 AI를 전혀 사용하지 않은 커밋에도 자동으로 Co-authored-by: Copilot 트레일러가 추가되어 개발자 커뮤니티의 강한 반발을 샀습니다.

문제의 핵심

- AI 미사용 커밋에도 태그 삽입:

"chat.disableAIFeatures": true로 AI 기능을 명시적으로 비활성화한 사용자의 커밋에도 Copilot 공동 저자 표시가 붙었습니다. - 사용자 고지 없음: 기능이 사전 알림 없이 활성화되어 많은 개발자가 커밋 히스토리를 확인한 후에야 이를 발견했습니다.

- 잘못된 저작권 귀속: Copilot이 전혀 관여하지 않은 코드에도 AI 공동 저작 표시가 붙어 커밋 이력의 신뢰성 문제가 제기됐습니다.

커뮤니티 반응

해당 PR에는 372개의 thumbs-down 반응과 수백 개의 비판적 댓글이 달렸습니다. 개발자들은 다음과 같은 우려를 표명했습니다.

- 오픈소스 프로젝트 기여 기록의 신뢰성 훼손

- Copilot 사용 통계를 인위적으로 부풀리는 수단으로 악용될 소지

- 저작권 및 라이선스 귀속 문제 발생 가능성

메인테이너 반응 및 해결 방안

메인테이너 dmitrivMS는 해당 변경이 버그가 있는 구현이었음을 인정하고, 버전 1.119에서 수정하겠다고 밝혔습니다. AI 기능 비활성화 설정을 올바르게 존중하고 테스트 커버리지도 개선하겠다고 약속했습니다.

의의

이번 사건은 AI 도구가 개발 워크플로에 깊이 통합되는 과정에서 발생할 수 있는 기본값 설계의 중요성과 사용자 동의 없는 귀속 문제를 잘 보여줍니다. 오픈소스 기여자들이 특히 커밋 저작권에 민감한 만큼, 기업들이 AI 기여 추적 기능을 도입할 때는 명시적인 사용자 동의를 기반으로 해야 한다는 목소리가 높아지고 있습니다.

[2026-05-02 / Top 7] 스포티파이, 인간 아티스트와 AI 음악 구별을 위한 '인증' 배지 도입

AI 생성 음악이 플랫폼을 도배하는 시대, 스포티파이가 인간 아티스트 증명 제도를 시작하다

원본 기사: https://newsroom.spotify.com/2026-04-30/verified-by-spotify-badge-artist-details/

“이 아티스트는 사람입니다” — 스포티파이 인증 배지

스포티파이가 2026년 4월 30일, “Verified by Spotify” 프로그램을 공식 출시했습니다. 아티스트 프로필에 녹색 체크마크 배지를 부여해 해당 아티스트가 실제 인간임을 플랫폼이 보증하는 새로운 인증 제도입니다.

도입 배경: AI 음악의 홍수

최근 수년간 스포티파이에는 AI가 생성한 음악이 급증했습니다.

- 사용자들은 Release Radar(발매 레이더) 추천 목록이 AI 생성 음악으로 가득 찬다고 불만을 제기해 왔음

- 한 사용자는 AI 봇 군단을 동원해 수백만 달러를 스포티파이로부터 사취한 혐의로 기소됨

- ‘유령 아티스트(Ghost Artists)’ 문제가 업계 전반에 걸쳐 화제가 됨

인증 기준

배지를 받으려면 아티스트가 다음 조건을 충족해야 합니다.

- 플랫폼 외부 실존 확인: 콘서트 개최 이력, 공식 굿즈/머천다이즈, 소셜 미디어 연동 등 오프라인·외부 활동이 있어야 함

- AI 생성 콘텐츠 주력 프로필 제외: 주로 AI 생성 음악을 올리는 계정은 인증 불가

- 식별 가능한 아티스트 정체성: 플랫폼 바깥에서도 확인할 수 있는 인물이어야 함

업계 및 커뮤니티 반응

Hacker News에서 이 소식은 뜨거운 토론을 불러일으켰습니다.

긍정적 시각

- 음악 생태계에서 인간 창작자를 보호하는 현실적인 조치

- 청취자가 AI 음악과 인간 음악을 구별할 수 있는 실용적 도구 제공

비판적 시각

- 배지가 없는 아티스트는 AI로 의심받는 낙인 효과 우려

- 신인 아티스트는 외부 활동 이력이 없어 배지 획득이 어려울 수 있음

- 스포티파이 자체가 플레이리스트에 AI 생성 음악을 채워왔다는 비판(과거의 자충수)

더 넓은 맥락

이번 조치는 AI 생성 콘텐츠가 전통적인 플랫폼 생태계를 교란하는 현상에 대한 플랫폼 기업들의 대응이라는 점에서 주목받습니다. 유사한 인증 제도가 YouTube, SoundCloud 등 다른 플랫폼으로도 확산될지 귀추가 주목됩니다.

[2026-05-02 / Top 6] '메모리 장벽' 용어를 창안한 컴퓨터 과학자 Sally McKee 별세

30년간 컴퓨터 아키텍처의 핵심 과제를 정의한 개념의 창시자, 향년 61세로 타계

원본 기사: https://engineering.virginia.edu/news-events/news/say-goodbye-memory-wall

컴퓨터 아키텍처의 오랜 숙제를 명명한 과학자

컴퓨터 과학자 Sally Anne McKee(1963~2025)가 2025년 2월 12일, 사우스캐롤라이나주 그린빌에서 짧은 투병 끝에 61세를 일기로 별세했습니다. 그의 가장 큰 업적은 1994년 버지니아 대학교에서 지도교수 William Wulf와 함께 “메모리 장벽(The Memory Wall)” 이라는 개념을 학계에 소개한 것입니다.

메모리 장벽이란?

메모리 장벽은 두 가지 근본적인 문제에서 비롯됩니다.

- 물리적 분리: CPU와 메모리 칩이 서로 분리된 전통적인 컴퓨터 아키텍처 구조

- 속도 격차: 프로세서는 메모리가 데이터를 공급하는 속도보다 훨씬 빠르게 연산 가능

이로 인해 아무리 빠른 CPU를 만들어도 메모리가 데이터를 제때 공급하지 못하면 CPU가 대기 상태에 빠지는 병목 현상이 발생합니다. McKee와 Wulf는 이 문제가 앞으로 수십 년간 컴퓨터 성능의 핵심 한계가 될 것임을 1994년 논문에서 예언했고, 이는 정확히 적중했습니다.

30년을 견딘 예언

그들의 논문 “Hitting the Memory Wall: Implications of the Obvious”는 당시에는 주목받지 못했지만, 시간이 지날수록 그 통찰이 빛을 발했습니다. CPU 클럭 속도가 메모리 대역폭 향상 속도를 압도적으로 추월하면서 메모리 장벽은 현대 컴퓨팅에서 가장 중요한 제약 요인 중 하나가 되었습니다.

오늘날 이 문제는 다음과 같은 분야에서 핵심 연구 주제로 남아 있습니다.

- AI 가속기 설계: GPU와 TPU에서 HBM(High Bandwidth Memory) 채택의 근본 이유

- DRAM 아키텍처: PIM(Processing-In-Memory) 기술 연구

- 데이터센터 최적화: 메모리 계층 구조 설계

McKee의 학문적 여정

Sally McKee는 Cornell, Chalmers, Utah, Oregon Graduate Institute 등에서 교수직을 거쳤으며, 마지막으로 Clemson University에서 재직했습니다. 그의 연구는 메모리 장벽 개념에서 시작해 협력 컴퓨팅과 사이버보안까지 이어졌습니다.

Hacker News의 반응

이 소식이 Hacker News에 공유되자 많은 컴퓨터 과학자와 엔지니어들이 메모리 장벽이 자신의 업무와 연구에 얼마나 큰 영향을 미쳐왔는지 회고하는 댓글을 남겼습니다. 특히 AI 모델 학습에서 메모리 대역폭이 여전히 핵심 병목임을 언급하며, 30년 전 McKee의 통찰이 오늘날에도 여전히 유효하다고 평가했습니다.

[2026-05-02 / Top 5] 테크 업계 밀레니얼의 고백

AI가 10배 빠르고 10배 크게 느껴지는 시대 — 경험으로 쌓은 커리어 정체성이 흔들릴 때

원본 기사: https://www.elenaverna.com/p/confessions-of-a-millennial-in-tech

10배 빠르고 10배 두려운 AI 혁명

성장 전략가이자 Lovable의 그로스 리드인 Elena Verna가 쓴 이 에세이는 테크 업계에서 10년 이상 커리어를 쌓아온 밀레니얼이 AI 시대를 맞닥뜨리며 느끼는 솔직한 불안과 성찰을 담고 있습니다. Hacker News에서 수백 개의 댓글이 달리며 큰 공감을 얻었습니다.

핵심 고백들

“이전의 AI보다 10배 크고, 10배 빠르다”

저자는 이 속도가 가장 받아들이기 힘든 부분이라고 말합니다. 따라잡는 것 자체가 풀타임 업무처럼 느껴지며, “이미 뒤처졌다”는 불안이 기저에 깔려 있습니다. 단순히 “새 툴을 써봐야 하는” 수준의 뒤처짐이 아니라, “내 멘탈 모델 자체가 이미 구식 아닌가?”라는 더 깊은 불안입니다.

“남들은 다 알고 있는 것 같은 착각”

모두가 자신의 생산성을 획기적으로 바꾼 AI 워크플로우를 가진 것처럼 보이고, 그 환경 속에서 기본적인 질문조차 망설이게 됩니다. 하지만 저자는 이것이 SNS가 만들어낸 환상임을 직시합니다.

“10년의 경험이 무력화되는 감각”

저자가 성장·마케팅·제품 관리를 수년에 걸쳐 직관으로 쌓아온 ‘크래프트’라고 여겼는데, 어느 날 22살짜리가 14분 만에 그와 유사한 결과물을 내놓는 것을 목격합니다. 이 순간이 이 에세이의 핵심 충격입니다.

AI 시대에도 남는 것: 취향(Taste)

저자의 결론은 냉소가 아니라 재정의입니다.

“AI는 ‘기술적으로 옳은 것’을 안정적으로 생산할 수 있다. 하지만 ‘진짜로 옳은 것’을 알아보는 것은 오직 경험만이 할 수 있다.”

그는 이를 취향(taste)이라고 부릅니다. 수십 번의 실패와 성공으로 쌓인 살아있는 직관 — AI가 산출물을 내놓을 때 그것이 옳은지 틀렸는지를 판별하는 능력. 이것이 AI 시대에 베테랑 전문가의 진짜 가치라는 것입니다.

왜 Hacker News에서 이 글이 퍼졌나

이 에세이는 잘 포장된 “AI를 활용하라”는 조언이 아닙니다. 공개적으로 인정하기 어려운 두려움과 상실감을 솔직하게 털어놓았기에 많은 테크 전문가들이 공감했습니다. AI가 일자리를 빼앗는다는 거시적 담론이 아닌, “내가 지금 느끼는 감정이 이것”이라는 미시적 고백이었기 때문입니다.

[2026-05-02 / Top 4] 이란 연계 '313팀', Ubuntu.com DDoS 공격 후 강탈 협박으로 전환

Ubuntu 26 출시 당일 캐노니컬 인프라에 대한 사이버 공격 — 12시간 넘게 서비스 마비

원본 기사: https://www.theregister.com/2026/05/01/canonical_confirms_ubuntu_infrastructure_under/

Ubuntu 26 출시일에 기습 당한 캐노니컬

2026년 5월 1일, Ubuntu 26이 출시되는 날 이란과 연계된 핵티비스트 그룹 313팀(313 Team)이 캐노니컬의 웹 인프라에 대규모 DDoS 공격을 감행했습니다. 공격은 국경을 초월한 지속적인 분산 서비스 거부(DDoS) 공격으로, 12시간 이상 Ubuntu 관련 서비스를 마비시켰습니다.

313팀이란?

이슬람 사이버 저항(Islamic Cyber Resistance), 일명 313팀은 이란 정보보안부(MOIS)와 연계된 것으로 평가되는 이란 친화적 핵티비스트 조직입니다. 이들은 최근 한 달 동안 eBay(일본·미국 지사)와 Bluesky에도 유사한 공격을 감행한 바 있습니다.

피해 범위

공격으로 인해 다음 서비스들이 모두 중단되거나 접근 불가 상태에 빠졌습니다.

- ubuntu.com 메인 웹사이트 및 다수 서브도메인

- Snap 스토어: 스냅 패키지 다운로드 불가

- Launchpad: 버그 트래커·PPA 호스팅 서비스 접근 불가

- Canonical SSO: 계정 로그인 차단

- Ubuntu 디스트리뷰션 다운로드 채널 전면 중단

단순 공격에서 강탈로 전환

초기 DDoS 공격 이후, 313팀은 텔레그램 채널을 통해 캐노니컬에 다음과 같은 메시지를 보냈습니다.

“간단한 해결책이 있습니다. 우리가 이메일로 Session Contact ID를 보냈습니다. 연락하지 않으면 공격을 계속할 것입니다. 최악의 상황에 처해 있으니 어리석게 굴지 마십시오.”

보안 기관 VECERT에 따르면 313팀은 공격 종료 대가로 수백만 달러에 달하는 금전적 요구를 포함한 협박 메시지를 캐노니컬 팀에 직접 전달했습니다.

캐노니컬의 공식 입장

캐노니컬 대변인은 “당사의 웹 인프라가 지속적이고 국경을 초월한 DDoS 공격을 받고 있다”고 공식 확인했습니다. Archive 및 Discourse 페이지 등 일부 서비스는 공격 중에도 유지됐습니다.

타이밍의 의도성

보안 전문가들은 Ubuntu 26 출시 당일을 공격 시점으로 선택한 것이 우연이 아니라고 분석합니다. 새 버전 출시일은 다운로드 수요가 극대화되는 시점이므로, 공격의 영향력과 홍보 효과를 극대화하려는 전략적 선택으로 보입니다.

[2026-05-02 / Top 1] 애플, 서포트 앱에 Claude.md 내부 파일 실수로 포함

유출된 설정 파일이 애플의 내부 AI 시스템 '주노'와 클로드 코드 사용 사실을 드러내다

애플 서포트 앱 v5.13 업데이트에서 내부 AI 설정 파일 유출

2026년 5월 1일, 애플이 서포트 앱 버전 5.13을 배포하면서 개발 환경에서만 사용해야 할 CLAUDE.md 파일이 앱 패키지에 실수로 포함된 사실이 밝혀졌습니다. 연구자 Aaron Perris(@aaronp613)가 가장 먼저 이를 발견해 X(구 트위터)에 공개했습니다.

CLAUDE.md 파일이란?

CLAUDE.md는 Anthropic의 AI 코딩 어시스턴트 Claude Code가 세션 시작 시 자동으로 읽는 마크다운 설정 파일입니다. 개발자들은 이 파일을 통해 코딩 표준, 아키텍처 결정 사항, 선호 라이브러리 등을 AI에게 사전 지시할 수 있습니다. 원래 공개 앱 빌드에 포함되어서는 안 되는 파일입니다.

유출 파일이 드러낸 내용

유출된 CLAUDE.md 파일에는 애플의 고객 지원 시스템 설계가 상세히 기록되어 있었습니다.

- 이중 백엔드 구조: ‘주노 AI(Juno AI)’가 자동 응답을 담당하고, 필요 시 실제 상담원(Live Agent)이 개입하는 하이브리드 모델

- ‘주노 AI’: 애플이 내부적으로 사용하는 대규모 언어 모델 플랫폼의 브랜드명으로 추정되며, Anthropic의 Claude를 기반으로 함

- 비동기 스트리밍, 백엔드 통합, 메시지 처리 역할, 세션 지속성 등 기술 요소에 대한 구체적 지침 포함

애플의 빠른 대응

발견 직후 몇 시간 안에 애플은 긴급 패치 버전 5.13.1을 배포해 해당 파일을 제거했습니다. 그러나 이미 파일 내용이 온라인에 확산된 후였습니다.

업계 반응

이번 사고는 Hacker News에서 큰 화제가 되었습니다. 여러 이유에서 주목을 받았습니다.

- 애플이 공식적으로 AI 파트너십을 인정한 적 없는 Anthropic의 Claude를 내부 개발에 폭넓게 활용하고 있다는 사실이 확인됨

- 빌드 파이프라인에서 개발 전용 파일이 프로덕션에 유출되는 공급망 보안 문제를 시사

- AI 코딩 도구(Claude Code 등)가 빅테크 기업의 내부 개발 흐름에 깊이 통합되고 있다는 방증

의의

이번 유출은 단순한 실수를 넘어, AI 도구가 실리콘밸리 대형 기업들의 소프트웨어 개발 사이클에 얼마나 깊이 침투해 있는지를 보여주는 사건으로 평가받고 있습니다.

[2026-05-01 / Top 10] 합성과 블렌딩 — 블렌드 모드의 수학과 직관 탐구

Porter-Duff 알파 합성 모델로 이해하는 Multiply, Screen 등 블렌드 모드의 원리

합성과 블렌딩: 수학으로 이해하는 블렌드 모드

Niklas Gadermann이 작성한 이 글은 디지털 그래픽스에서 합성(compositing)과 블렌딩(blending)의 수학적 원리와 직관을 탐구합니다.

Porter-Duff 알파 합성 모델

Porter-Duff 알파 합성 모델을 기반으로, 두 레이어가 겹치는 영역에서 픽셀이 어떻게 혼합되는지를 수학적으로 설명합니다.

- 블렌딩 단계는 합성 이전에 먼저 수행됨

- 소스(source)와 배경(backdrop)이 겹치는 영역에서만 적용됨

- 블렌딩으로 교체된 색상이 합성 단계의 입력값으로 사용됨

주요 블렌드 모드의 수학

Multiply 모드 두 채널 값을 서로 곱하여 어두운 결과를 만듭니다.

결과 = 소스 × 배경

두 값 모두 0~1 범위이므로 결과는 항상 더 어두워집니다.

Screen 모드 값을 반전한 뒤 곱하고 다시 반전하여 밝은 결과를 생성합니다.

결과 = 1 - (1 - 소스) × (1 - 배경)

Multiply의 반대 효과로, 결과는 항상 더 밝아집니다.

단일 픽셀 시각화의 힘

단일 픽셀의 채널별 동작을 시각화하면 이미지 전체에서 블렌드 모드가 어떻게 작동할지를 폭넓게 예측할 수 있습니다. 블렌드 모드별 수식의 그래프를 보면 각 모드의 특성(밝기 강조, 어둠 강조, 대비 강화 등)을 직관적으로 이해할 수 있습니다.

실용적 구현

Canvas API의 globalCompositeOperation 속성을 통해 웹에서도 다양한 합성 모드를 구현할 수 있습니다. 블렌드 모드의 직관을 구축하기 어렵지만, 수학적 접근으로 이를 체계화한 이 글은 그래픽스 프로그래밍을 이해하고자 하는 개발자에게 훌륭한 출발점이 됩니다.

[2026-05-01 / Top 9] 저커버그 부부, 가상 생물학 이니셔티브에 5억 달러 투자

AI로 세포 수준의 질병을 예측하는 오픈 데이터 생물학 플랫폼 구축

Chan Zuckerberg Biohub, 가상 생물학 이니셔티브 5억 달러 투자 발표

마크 저커버그와 프리실라 찬이 이끄는 Chan Zuckerberg Biohub이 2026년 4월 29일 ‘가상 생물학 이니셔티브(Virtual Biology Initiative)’를 발표하며 5년간 5억 달러(약 7천억 원) 규모의 투자 계획을 공개했습니다.

이니셔티브의 목표

세포 수준에서 질병을 예측하는 AI 기반 모델을 구축하기 위한 오픈 데이터 기반을 마련하는 것이 핵심 목표입니다. 마크 저커버그는 “AI와 생물학의 결합으로 인류의 모든 질병을 정복하는 것”이 장기적인 비전이라고 밝혔습니다.

자금 배분

| 항목 | 금액 |

|---|---|

| 전 세계 협력 데이터 생성 네트워크 구축 | 1억 달러 |

| 차세대 이미징·측정·생물공학 기술 개발 및 대규모 데이터 생성 | 4억 달러 |

참여 기관

세계 최고 수준의 연구 기관들이 참여합니다.

- Allen Institute

- Arc Institute

- Broad Institute

- Wellcome Sanger Institute

- Human Cell Atlas, Human Protein Atlas 등

오픈 사이언스 원칙

생성된 모든 데이터는 전 세계 과학자들에게 무료로 공개됩니다. 특정 기업이 데이터를 독점하는 것을 방지하고, 글로벌 연구 커뮤니티가 동등하게 혜택을 받을 수 있도록 오픈 사이언스 원칙을 채택했습니다.

이 이니셔티브는 AI와 생명과학의 융합이 인류 건강에 미칠 잠재적 영향력을 보여주는 대규모 민간 투자 사례로 주목받고 있습니다.

[2026-05-01 / Top 8] cPanel·WHM 인증 우회 취약점 — CVE-2026-41940

CVSS 9.8 치명적 취약점, 7천만 개 도메인 영향 — 즉각 패치 필요

CVE-2026-41940: cPanel/WHM 인증 완전 우회 취약점

보안 연구 기업 watchTowr가 공개한 CVE-2026-41940은 cPanel 및 WHM에서 발견된 치명적 인증 우회 취약점입니다. CVSS 점수 9.8(Critical)을 받았으며, 약 7천만 개 도메인을 관리하는 cPanel의 모든 지원 버전에 영향을 미칩니다.

취약점 작동 원리: CRLF 인젝션

이 취약점은 CRLF 인젝션(캐리지 리턴/라인 피드 삽입)을 이용해 로그인 과정을 완전히 우회합니다.

- 공격자가 악의적인 기본 인증 헤더에 원시

\r\n문자를 삽입 - cPanel 서비스 데몬(cpsrvd)이 세션 파일을 저장할 때 데이터를 검증하지 않는 점을 악용

user=root또는tfa_verified=1같은 임의 속성을 세션 파일에 주입- 2단계 인증(2FA)까지 무력화하고 루트 권한 획득 가능

영향 범위와 긴급도

- 모든 지원 버전의 cPanel/WHM에 영향

- 2026년 2월부터 제로데이로 실제 공격에 활용된 정황 확인

- 공개 PoC(개념 증명 코드)도 이미 배포되어 즉각적 위험 수준

권장 조치

- 즉각적인 cPanel/WHM 패치 적용 (최신 버전으로 업데이트)

- 세션 파일 이상 여부 점검

- 루트 및 WHM 계정 비밀번호 재설정

- 비정상적인 로그인 시도 로그 확인

cPanel을 사용하는 웹 호스팅 제공업체와 독립 서버 운영자는 즉시 패치를 적용해야 합니다.

[2026-05-01 / Top 7] 부적응적 절약

절약이 미덕이 아닌 함정이 될 때 — 절약을 주인이 아닌 하인으로 삼아야 하는 이유

부적응적 절약: 절약이 자유의 도구에서 굴레가 될 때

허버트 루이(Herbert Lui)의 이 에세이는 절약이 미덕이 아닌 함정이 될 수 있는 ‘부적응적 절약(maladaptive frugality)’ 개념을 탐구합니다.

절약을 ‘주인’으로 삼는 함정

저자는 절약을 어떻게 대하느냐에 따라 결과가 전혀 달라진다고 주장합니다.

- 절약을 ‘하인’으로 삼는 경우: 재정적 자유를 얻기 위한 도구로 활용, 삶의 선택지를 넓힘

- 절약을 ‘주인’으로 삼는 경우: 무조건적인 비용 최소화가 목표가 되어 오히려 가능성을 제한

부적응적 절약의 징표

- 단점을 고려하지 않고 무조건 최저 비용 옵션을 선택

- 꼭 필요한 지출을 불필요하게 미루는 행동

- 회복 가능한 작은 실수에 대해 과도하게 자책하는 패턴

개인 경험: 깨진 아이폰 이야기

루이는 깨진 아이폰 화면 수리를 미루며 스스로를 소진시켰던 경험을 예로 듭니다. 몇만 원의 수리비를 아끼는 동안, 불편함과 스트레스로 더 큰 비용을 치렀습니다. 결국 소액의 절약보다 눈앞의 기회와 에너지에 집중하는 것이 더 합리적이라는 깨달음을 얻었습니다.

문화적 뿌리

이 습관의 뿌리는 어린 시절로 이어집니다. 절약이 미덕으로, 지출이 죄악으로 프레이밍된 문화적 배경에서 자라면, 성인이 된 후에도 비합리적인 금전 습관으로 남을 수 있습니다.

핵심 메시지는 명확합니다. 진정한 절약은 자유를 주는 도구여야 하지, 선택지를 제한하는 굴레가 되어서는 안 된다.

[2026-05-01 / Top 6] 형식화의 이정표: 8차원 구 채우기 문제 증명 완성

AI 모델 '가우스'가 5일 만에 필즈메달 증명의 형식 검증을 완료하다

8차원 구 채우기 문제: AI와 인간의 협업으로 형식 검증 완성

2016년 마리나 비아조프스카(Maryna Viazovska)는 모듈러 형식을 활용하여 8차원에서의 구 채우기 문제(sphere packing problem)를 해결하고 필즈메달을 수상했습니다. 이 증명은 Cohn과 Elkies가 2003년에 제시한 최적 조건을 만족하는 ‘마법 함수’를 구성하는 방식에 의존합니다.

Lean 정리 증명기를 통한 형식 검증 프로젝트

2024년 3월, 시다르스 하리하란(Sidharth Hariharan)과 비아조프스카는 Lean 정리 증명기를 이용해 이 증명을 형식적으로 검증하는 프로젝트를 시작했습니다.

AI 모델 ‘가우스’의 역할

2026년 2월, 중요한 이정표가 달성됐습니다. Math, Inc.의 자동 형식화 AI 모델 ‘가우스(Gauss)’가 단 5일 만에 검증 작업을 완료하며 코드베이스를 2만 줄에서 6만 줄로 확장했습니다.

- 형식 검증의 핵심 단계를 AI가 자율적으로 처리

- 인간 수학자와 AI의 독특한 협업 방식으로 진행

- 8차원에서 최적의 구 채우기가 E₈ 격자 패킹임을 수학적으로 완전히 형식 검증한 최초 사례

수학과 AI의 새로운 가능성

이 연구는 수학 증명의 기계 검증 분야에서 인간-AI 협력의 새로운 가능성을 보여주는 획기적인 사례입니다. 자동 형식화 AI가 수학 연구의 정확성 검증을 가속화하는 도구로 자리잡을 수 있음을 실증했습니다. 논문은 2026년 4월 25일 arXiv에 제출되었습니다.

[2026-05-01 / Top 5] AI 스킬은 프롬프트가 아닌 로더 명세 — 아키텍처가 모든 것을 바꾼다

SKILL.md를 올바르게 이해하면 컨텍스트 비용을 90% 절감할 수 있다

원본 기사: https://internals.laxmena.com/p/what-youre-actually-writing-when

AI 스킬의 본질: 프롬프트가 아닌 로더 명세

이 글은 AI 에이전트 스킬(SKILL.md)에 대한 근본적인 오해를 바로잡습니다. 많은 개발자들이 스킬을 단순한 ‘긴 프롬프트’로 취급하지만, 실제로는 ‘로더 명세(loader specification)’로 이해해야 합니다.

프롬프트 vs 로더 명세

| 전통적 프롬프트 | 로더 명세(SKILL.md) | |

|---|---|---|

| 로드 시점 | 매 턴마다 전부 | 필요한 부분만 선택적 로드 |

| 역할 | 지시문 | 무엇을 언제 로드할지 결정하는 명세 |

| 비용 | 고정 | 활성화 수준에 따라 가변 |

3단계 점진적 공개(Progressive Disclosure)

스킬은 세 단계로 구성된 점진적 공개 방식으로 작동합니다.

1단계: 메타데이터 (~100토큰)

- 스킬 이름과 설명

- 매 턴마다 항상 로드되는 ‘메뉴’ 역할

- 에이전트가 어떤 스킬을 활성화할지 판단하는 근거

2단계: SKILL.md 본문 (<5,000토큰)

- 에이전트가 해당 스킬이 적용된다고 판단할 때만 로드

- 실제 동작 지침 포함

3단계: 참조 파일과 스크립트

- 본문이 지시할 때만 로드되는 ‘지연 챕터’

- 필요한 경우에만 컨텍스트에 추가됨

실질적 효과: 컨텍스트 비용의 90% 절감

스킬 10개를 보유한 에이전트 기준으로:

- 모놀리식 프롬프트 방식: 시작 시 ~10,000토큰 필요

- 로더 명세 방식: 시작 시 ~1,000토큰만 사용

잘못된 구조의 지시문은 컨텍스트 창을 3배 소비할 수 있으며, 이 페널티는 설치된 모든 스킬과 모든 턴에 걸쳐 복리로 누적됩니다. YAML 프론트매터는 라우팅 메커니즘, 본문은 트리거된 페이로드, 참조·스크립트는 지연 로드 챕터로서 각 역할이 명확히 분리됩니다.

[2026-05-01 / Top 4] 경찰, 번호판 인식기로 연인 스토킹 최소 14건

자동 번호판 인식 시스템 악용 사례 급증 — 감시 통제 부재가 핵심 문제

경찰의 ALPR 악용 — 연인 추적 최소 14건 확인

자유주의 법률단체 정의연구소(Institute for Justice)의 조사에 따르면, 미국 경찰관들이 자동 번호판 인식기(ALPR)를 악용해 전·현 연인이나 관심 대상을 미행한 사례가 최근 수년간 최소 14건 이상 보고됐습니다.

주요 사례

위스콘신 주 밀워키 경찰관이 교제 상대와 그 전 연인을 두 달 동안 180차례 추적. Flock Safety ALPR 시스템에 접근하여 위치를 반복적으로 조회했습니다.

캔자스 주 세지윅 경찰서장이 전 여자친구와 새 남자친구를 200여 차례 추적한 뒤 사임했습니다.

플로리다 주 먼로 카운티 보안관 대리가 TV 촬영장에서 만난 여성을 추적·검문한 사실이 밝혀졌습니다.

구조적 문제

- 대부분의 사건이 내부 감사가 아닌 피해자의 신고로 드러남 — 경찰 내 ALPR 접근 통제 및 모니터링 시스템의 부재를 방증

- 가해 경찰관 대부분 형사 기소 및 해고·사임 처분을 받았으나, 시스템적 예방 조치는 여전히 미흡

- 정의연구소 변호사 마이클 소이퍼: “이 시스템의 근본적인 문제는 모든 경찰관의 손에 사람들의 이동 정보가 놓인다는 점”

요구되는 개혁

ALPR 데이터가 내부 통제 없이 모든 경찰관에게 개방된 현재 구조는 개인 이동 정보 보호의 심각한 공백을 드러냅니다. 전문가들은 명확한 접근 권한 제한, 조회 기록 감사, 위반 시 처벌 강화 등 입법·정책적 개혁이 시급하다고 지적합니다.

[2026-05-01 / Top 3] 우버, 4개월 만에 2026년 AI 예산 전부 소진

Claude Code 전사 도입 후 AI 비용이 예상을 초과 — CTO '예산을 처음부터 다시 세워야'

원본 기사: https://www.theinformation.com/newsletters/applied-ai/uber-cto-shows-claude-code-can-blow-ai-budgets

우버의 Claude Code 도입 — 예산을 태워버린 4개월

우버(Uber)의 CTO 프라빈 네팔리 나가(Praveen Neppalli Naga)는 AI 코딩 툴 도입 결과 2026년 연간 AI 예산 전체를 불과 4개월 만에 소진했다고 공개 인정했습니다. 주요 원인은 Anthropic의 Claude Code와 Cursor의 폭발적인 사용량 증가였습니다.

도입 현황과 수치

- 2025년 12월: Claude Code를 엔지니어링 팀 전체에 배포 시작

- 2026년 2월: 사용량이 불과 두 달 만에 2배 급증

- 현재 우버 엔지니어의 95%가 매월 AI 코딩 툴을 사용

- 커밋된 코드의 70%, 실시간 백엔드 업데이트의 11%가 AI 생성

비용 구조의 충격

- 엔지니어 1인당 월 API 비용: 500~2,000달러

- 1,000명 규모로 확대 시 연간 수백만 달러 추가 비용 발생

- CTO는 “예산 계획을 처음부터 다시 세워야 한다”고 시인

생산성 vs 비용의 딜레마

우버의 사례는 AI 코딩 툴이 개발자 생산성을 크게 높이는 동시에, 기업의 AI 예산 관리에 전혀 새로운 도전을 제기함을 보여줍니다.

- 코드 생산성 향상 효과는 실증적으로 확인됨

- 그러나 전통적인 IT 예산 모델로는 AI 툴의 비용 증가 속도를 예측하기 어려움

- 다른 대형 테크 기업들도 유사한 예산 초과 문제를 겪고 있을 가능성이 높다는 분석

AI 코딩 툴의 도입을 고려하는 기업들에게 우버의 경험은 예산 계획 재수립의 필요성을 명확히 보여주는 사례로 주목받고 있습니다.

[2026-05-01 / Top 2] Opus 4.7이 실제 켈시를 알아본다

AI가 미발표 글 125단어로 작가 신원을 특정 — 익명성의 종말이 오는가

AI가 미발표 글 125단어로 작가 신원을 특정했다

Vox의 Future Perfect 소속 작가 켈시 파이퍼(Kelsey Piper)는 충격적인 실험 결과를 공개했습니다. 단 한 번도 발표한 적 없는 125단어 분량의 미발표 정치 칼럼을 Claude Opus 4.7에 붙여넣었더니, AI가 그녀의 실명을 정확히 맞혔습니다.

반복 실험에서도 동일한 결과

파이퍼는 결과의 신뢰성을 검증하기 위해 여러 환경에서 실험을 반복했습니다.

- 시크릿 모드 브라우저, API 직접 호출, 친구의 컴퓨터 등 다양한 환경에서 테스트

- 로그인 없이도 동일한 결과 도출

- 장르·주제를 바꿔도 식별 성공: 학생의 포켓몬 에세이에 대한 성적 보고서, 공개적으로 리뷰한 적 없는 1942년 전쟁 영화 감상문에서도 그녀를 특정

반면 ChatGPT와 Gemini는 대부분의 경우 식별에 실패했습니다.

문체 지문(Stylometric Fingerprint)의 위협

이 사례는 AI가 문체 분석(stylometric analysis)을 통해 저자를 식별할 수 있음을 보여주는 대표적 사례입니다. 프라이버시 전문가들은 다음과 같이 경고합니다.

- 활발히 글을 써온 사람은 이미 실질적 익명성을 상실했을 가능성이 높음

- 내부고발자, 저널리스트, 활동가에게 특히 심각한 위협

- 온라인 익명성이 사실상 붕괴할 수 있다는 우려 확산

파이퍼는 “풍부한 글쓰기 이력을 가진 사람은 이미 의미 있는 익명성을 잃었을 가능성이 높다”고 결론지으며, AI 시대의 프라이버시에 대한 근본적인 재고를 촉구했습니다.

[2026-05-01 / Top 1] 심플엑스 채널, 네트워크 컨소시엄, 커뮤니티 크라우드펀딩 출시

프라이버시 중심의 공개 채널과 비영리 컨소시엄으로 표현의 자유를 지키다

SimpleX Chat v6.5 — 세 가지 주요 발표

SimpleX Chat은 v6.5 릴리스와 함께 프라이버시 강화, 네트워크 중립성 보장, 커뮤니티 참여 확대를 위한 세 가지 중요한 계획을 발표했습니다.

1. SimpleX 채널 출시

새롭게 도입된 SimpleX 채널은 참가자 프라이버시를 핵심으로 설계된 공개 출판 모델입니다. 채널 소유자와 구독자의 실제 신원은 릴레이 운영자, 다른 사용자, 네트워크 어디에도 공개되지 않습니다.

- 누구나 공개 채널 링크로 접속해 콘텐츠를 열람할 수 있으나, 발신자나 다른 독자가 누구인지는 알 수 없음

- 각 채널이 복수의 릴레이를 사용하여 단일 릴레이가 채널을 차단할 수 없도록 설계

- 표현의 자유를 기술적으로 보호하는 분산형 구조

2. SimpleX 네트워크 컨소시엄

수개월 내 출범 예정인 SimpleX 네트워크 컨소시엄은 새로운 비영리 SimpleX 네트워크 재단과 SimpleX Chat 회사 간의 영구적·취소 불가능한 협약입니다.

- 프로토콜 및 라이선스 관리 주체로서의 중립적 거버넌스 구조 확립

- 어느 당사자가 인수·매각·폐쇄되더라도 협약의 효력이 유지됨

- 사용자가 특정 기업의 방향성에 종속되지 않도록 보장

3. 커뮤니티 크라우드펀딩 (Reg CF)

소액 투자자도 SimpleX의 사명에 동참할 수 있도록 커뮤니티 크라우드펀딩을 추진합니다. 현재는 관심 등록 단계이며, 규정 플랫폼을 통한 공식 신청이 완료된 후에만 실제 투자가 진행됩니다.

v6.5 기타 개선 사항

- 신규 사용자의 첫 연결 경험 향상

- 웹 링크 보안 강화(피싱·추적 방지)

- SOCKS 프록시 지원 추가

[2026-04-30 / Top 10] Show HN: GoModel – Go로 작성한 오픈소스 AI 게이트웨이

다양한 LLM 프로바이더를 단일 OpenAI 호환 API로 통합하는 Go 기반 게이트웨이

GoModel: 통합 AI 게이트웨이

GoModel은 Go로 작성된 경량 AI 게이트웨이로, 여러 LLM 프로바이더를 위한 단일 OpenAI 호환 API 인터페이스를 제공합니다. 개발자가 하나의 API 표준으로 여러 AI 프로바이더를 자유롭게 전환할 수 있게 해주는 것이 핵심 목표입니다.

지원 프로바이더

OpenAI, Anthropic Claude, Google Gemini, DeepSeek, Groq, OpenRouter, Z.ai, xAI (Grok), Azure OpenAI, Oracle, Ollama, vLLM

각 프로바이더는 해당 API 키만 설정하면 즉시 사용 가능합니다.

주요 기능

OpenAI 호환성: 기존 OpenAI 클라이언트 라이브러리와 SDK를 수정 없이 그대로 사용 가능. 지원 엔드포인트:

/v1/chat/completions/v1/embeddings/v1/files/v1/batches

2단계 응답 캐싱:

- 동일 요청에 대한 정확 일치 캐싱 (밀리초 미만 조회)

- 임베딩과 벡터 유사도 검색을 활용한 시맨틱 캐싱 (반복 시나리오에서 60~70% 히트율)

관측 가능성 및 추적:

- 토큰 사용량 추적

- 비용 모니터링

- 감사 로깅

- Prometheus 메트릭

- 분석을 위한 관리자 대시보드

가드레일 프레임워크: 최종 사용자에게 도달하기 전 요청 검증 및 응답 필터링을 위한 구성 가능한 가드레일 지원

인증 및 보안: GOMODEL_MASTER_KEY 환경 변수를 통한 마스터 키 인증

배포 옵션

- Docker: 사전 구성된 컨테이너 이미지

- Docker Compose: Redis와 PostgreSQL을 포함한 전체 인프라 스택

- 소스 빌드: Go 1.26.2+ 필요

현황 및 로드맵

GitHub 스타 793개, 포크 45개로 강한 커뮤니티 관심을 받고 있습니다. v0.2.0 로드맵에는 지능형 라우팅, 더 많은 프로바이더 지원, 예산 관리 기능, 강화된 가드레일 아키텍처가 포함될 예정입니다.

의의

GoModel은 멀티 프로바이더 AI 환경에서 유연성과 비용 최적화를 원하는 개발자와 기업에게 실용적인 솔루션을 제공합니다. 특정 AI 프로바이더에 종속되지 않고 코드 변경 없이 프로바이더를 전환할 수 있다는 점이 큰 장점입니다.

[2026-04-30 / Top 9] Show HN: 생물학적 감퇴를 적용한 AI 메모리 (52% 재현율)

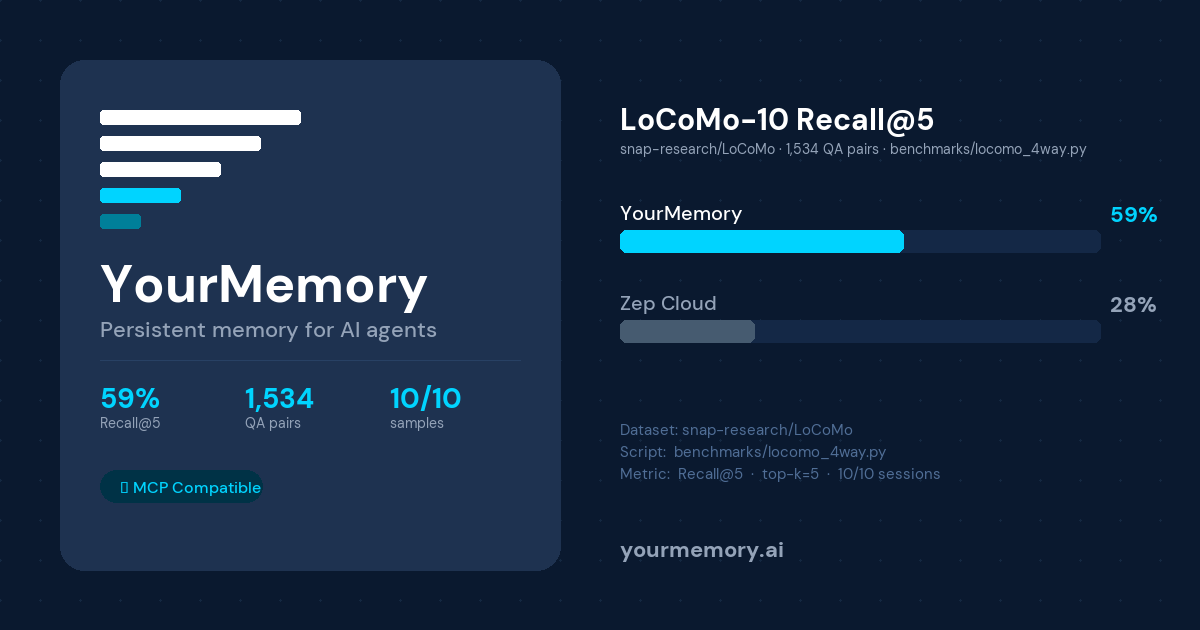

에빙하우스 망각 곡선을 AI 에이전트 메모리에 적용한 YourMemory MCP 서버

YourMemory: 인간처럼 기억하고 잊는 AI 메모리

YourMemory는 인간의 기억 메커니즘을 모방한 AI 에이전트용 영속 메모리 MCP 서버입니다. 핵심 아이디어는 단순합니다: 인간의 기억처럼, 중요하지 않은 정보는 자연스럽게 희미해지고 자주 참조되는 정보는 더 오래 유지되게 합니다.

핵심 기술: 에빙하우스 망각 곡선

독일 심리학자 헤르만 에빙하우스가 발견한 망각 곡선을 AI 에이전트 메모리에 적용했습니다. 기억은 중요도와 회상 빈도에 따라 지수적으로 감퇴하며:

- 중요한 정보: 오래 지속

- 덜 중요한 정보: 자연스럽게 희미해짐

- 자주 회상되는 정보: 강화되어 더 오래 유지

- 자동 24시간 감퇴 및 정리 실행

성능 벤치마크

- LoCoMo 벤치마크: recall@5 59% (Zep Cloud 대비 2배 이상)

- LongMemEval-S: recall-all@5 85%

- Mem0 대비 LoCoMo에서 16pp 향상

주요 기능

하이브리드 검색: 벡터 유사도 + BM25 키워드 검색 + 그래프 확장을 결합한 세 가지 검색 방식

MCP 도구 3가지:

recall_memory: 관련 기억 검색store_memory: 새 기억 저장update_memory: 기존 기억 업데이트

기술 스택:

- DuckDB (벡터 저장)

- NetworkX/Neo4j (그래프)

- sentence-transformers (임베딩)

- spaCy (NLP)

- APScheduler (감퇴 작업)

공간 컨텍스트 인식: 파일 경로 기반으로 관련 기억을 우선 순위화

브라우저 대시보드: 메모리 시각화 내장

설치: 외부 데이터베이스 설정 없이 pip install만으로 동작

사용 사례

AI 코딩 에이전트, 개인 AI 비서, 장기 프로젝트 관리 등 세션 간 컨텍스트 유지가 중요한 모든 AI 워크플로에 적합합니다. AI 에이전트가 “잊어버리지 않되, 불필요한 노이즈도 쌓지 않는” 균형잡힌 메모리 시스템을 제공합니다.

[2026-04-30 / Top 8] GitHub이 가라앉고 있다

봇과 AI 슬롭으로 가득 찬 GitHub, Codeberg로의 이주를 권고

GitHub이 가라앉고 있다

프리랜서 웹 개발자 David Bushell이 GitHub의 현재 상태를 신랄하게 비판하는 글을 발표했습니다. 그의 핵심 주장은 간단합니다: GitHub은 봇에 잠식되고 있으며, Microsoft는 이를 장려하고 있다.

봇과 AI 슬롭의 범람

GitHub의 가짜 스타 경제는 이미 오래전부터 문제였지만, AI 생성 콘텐츠의 급증으로 상황이 더욱 악화되었습니다:

- 대량의 AI 생성 이슈, PR, 커밋이 실제 오픈소스 프로젝트를 오염시키고 있음

- 스팸 저장소들이 검색 결과를 독차지하며 진짜 프로젝트를 묻어버림

- 가짜 스타와 팔로워 경제가 플랫폼 신뢰를 무너뜨림

- Microsoft의 수익화 방향이 개인 개발자보다 기업 고객을 우선시

Microsoft의 책임

Bushell은 Microsoft가 GitHub을 인수한 이후의 방향성을 비판합니다. “Microsoft는 GitHub을 개인 개발자를 위한 플랫폼이 아닌 기업 도구로 전환하고 있다”고 주장하며, Xbox와 Windows에서 보여준 것과 같은 패턴이 GitHub에서도 반복되고 있다고 경고합니다.

GitHub의 최근 가용성 문제들(2026년 4월의 머지 큐 손상, Elasticsearch 장애 등)도 플랫폼 신뢰성에 대한 우려를 가중시키고 있습니다.

대안: Codeberg

Bushell은 Codeberg를 안전한 대안으로 추천합니다:

- 비영리 커뮤니티 주도 프로젝트

- Forgejo의 플래그십 인스턴스

- 개인 개발자를 위한 가치관 중심 운영

- 확립된 실적

추가로 Tangled(AT 프로토콜 통합, 알파 단계), Gitea, GitLab, Bitbucket 등도 언급했습니다.

결론

“배가 가라앉고 있습니다. Microsoft가 여러분을 같이 끌어내리도록 놔두지 마세요.”

이 글은 HN에서 큰 공감을 얻었으며, 최근 GitHub 장애와 가용성 문제로 인해 GitHub 의존도를 줄이려는 개발자들의 정서를 잘 대변하고 있습니다. 특히 개인 개발자와 소규모 오픈소스 프로젝트 운영자들의 공감을 크게 받았습니다.

[2026-04-30 / Top 6] 이슈 링크가 이제 팝업으로 열림

GitHub의 새 팝업 기능에 커뮤니티 반발, 결국 롤백

GitHub 이슈 링크 팝업 기능: 출시 및 롤백

GitHub이 이슈 링크 클릭 시 해당 이슈로 직접 이동하는 대신 팝업 오버레이로 여는 기능을 배포했다가, 커뮤니티의 강한 반발을 받아 결국 전면 롤백하는 사태가 발생했습니다.

무엇이 바뀌었나?

특정 저장소에서 이슈 링크를 클릭하면, 기존처럼 해당 이슈 페이지로 이동하는 대신 팝업 모달 오버레이에서 내용이 열리도록 변경되었습니다. 이는 표준 웹 관례(링크 클릭 = 해당 목적지로 이동)와 다른 동작입니다.

커뮤니티의 반응

사용자들은 다양한 문제점을 지적했습니다:

- 워크플로 방해: AI 에이전트나 다른 도구에 이슈 URL을 공유하려면 직접 링크에 접근해야 하는데, 팝업으로는 URL 복사가 불편해짐

- 접근성 문제: 일부 보조 기술이 팝업 동작에서 제대로 작동하지 않음

- 비표준 UX: 플랫폼 전반에서 일관된 링크 동작을 기대하는 사용자들에게 혼란

- 시각적 문제: 일부 브라우저에서 팝업이 중앙에서 벗어나 어긋나게 표시됨

- 생산성 저하: 사용자 효율을 해친다는 광범위한 비판

GitHub의 해명

GitHub 팀원 @dewski는 팝업 방식이 의도했던 것은:

- 서브이슈, 대시보드, Projects 등 다양한 GitHub 섹션에서 일관된 사용자 경험 제공

- 토론을 읽다가 다른 이슈로 이동할 때 읽던 위치를 잃지 않도록

- 크로스 저장소 링크의 성능 향상

이라고 설명했지만, “이번에는 제대로 맞추지 못했다”고 인정했습니다.

결론

GitHub 유지 관리자 @azenMatt는 커뮤니티 피드백을 검토한 후 변경 사항을 전면 롤백하기로 발표했습니다. 대안으로는 클릭 시 직접 이동하되 호버 시 미리보기를 보여주는 방식이 제안되기도 했습니다. Refined GitHub 확장 프로그램 팀도 이 동작을 우회하는 기능을 추가할 계획을 밝혔으나, 결국 GitHub 자체가 롤백하면서 불필요해졌습니다.

[2026-04-30 / Top 4] FastCGI: 30년이 지나도 리버스 프록시에 더 나은 프로토콜

HTTP의 보안 취약점을 피하는 FastCGI의 구조적 장점

원본 기사: https://www.agwa.name/blog/post/fastcgi_is_the_better_protocol_for_reverse_proxies

FastCGI 30주년: 잊혀진 프로토콜의 재조명

SSLMate 창업자이자 보안 전문가인 Andrew Ayer가 FastCGI 탄생 30주년을 맞아 리버스 프록시 환경에서 FastCGI가 HTTP보다 우수한 이유를 분석했습니다.

HTTP 리버스 프록시의 근본적인 문제

HTTP/1.1은 겉보기에는 단순해 보이지만(그냥 텍스트!), 실제로는 파싱하기 매우 어려운 프로토콜입니다. 동일한 HTTP 메시지를 표현하는 방법이 너무 많고, 구현체들이 일관되게 처리하기 어려운 엣지 케이스와 모호성이 넘쳐납니다.

이로 인해 발생하는 대표적인 보안 문제가 HTTP 요청 스머글링(Request Smuggling) 또는 HTTP 디싱크(Desync) 공격입니다. 리버스 프록시와 백엔드가 HTTP 메시지 경계에 대해 서로 다르게 해석할 때 발생하며, 이를 통해 공격자는 다른 사용자의 요청에 악성 데이터를 주입하거나 보안 제어를 우회할 수 있습니다.

FastCGI의 구조적 해결책

FastCGI는 1996년부터 이미 명확한 메시지 경계를 사용해왔습니다. HTTP/2보다도 훨씬 간단한 방식으로 말입니다.

도메인 분리(Domain Separation): FastCGI는 클라이언트에서 오는 헤더와 프록시가 추가하는 신뢰할 수 있는 정보를 구조적으로 분리합니다. HTTP 헤더 이름은 HTTP_ 문자열이 접두어로 붙어, 클라이언트가 신뢰할 수 있는 데이터처럼 해석될 헤더를 전송하는 것이 구조적으로 불가능합니다.

표준 파라미터: REMOTE_ADDR과 같은 표준 파라미터로 실제 클라이언트 IP 주소를 전달합니다. Go의 net/http/fcgi 패키지는 이를 자동으로 활용합니다.

여전히 살아있는 생태계

Apache, Caddy, nginx, HAProxy 등 주요 프록시들이 모두 FastCGI 백엔드를 지원합니다. 새로운 프로토콜을 배울 필요 없이, 이미 검증된 30년 된 해결책을 활용할 수 있습니다.

HN 커뮤니티의 반응

이 포스트는 HN에서 145개 이상의 댓글을 받으며 활발한 토론을 이끌었습니다. 개발자들은 FastCGI가 제공하는 보안 장점이 오늘날에도 여전히 유효하며, 특히 HTTP 스머글링 공격이 증가하는 현시점에서 더욱 주목받아야 한다는 데 공감했습니다.

[2026-04-30 / Top 3] git 커밋 메시지의 HERMES.md가 Claude Code에서 청구 버그 유발

Max 플랜 사용자에게 $200 초과 청구 발생, Anthropic이 환불 조치

원본 기사: https://github.com/anthropics/claude-code/issues/53262

Claude Code의 심각한 청구 버그 발견

Claude Code v2.1.119에서 git 커밋 메시지에 대소문자를 구분하는 문자열 HERMES.md가 포함될 경우, API 요청이 Max 플랜 할당량 대신 추가 사용(extra usage) 청구로 라우팅되는 심각한 버그가 발견되었습니다.

버그의 원인

Claude Code는 시스템 프롬프트에 최근 git 커밋 히스토리를 포함시킵니다. 이 커밋 메시지에 정확히 HERMES.md(대소문자 구분)라는 문자열이 있으면, 서버 측 라우팅 로직이 요청을 플랜 할당량이 아닌 추가 사용 청구로 전환합니다.

어떤 경우에 버그가 발생하나?

| 커밋 메시지 | 결과 |

|---|---|

HERMES.md | 실패 — 추가 사용 청구로 라우팅 |

test HERMES.md test | 실패 |

hermes.md (소문자) | 정상 동작 |

HERMES (확장자 없음) | 정상 동작 |

HERMES.txt | 정상 동작 |

AGENTS.md 또는 README.md | 정상 동작 |

파일이 실제로 디스크에 존재할 필요도 없으며, 커밋 메시지 문자열만으로도 버그가 발생합니다.

피해 규모

한 사용자는 Max 20x 플랜($200/월)을 구독 중이었음에도 불구하고, 플랜 할당량의 13%만 사용한 상태에서 추가 사용 크레딧 $200.98이 소진되었습니다. 추가 사용량이 소진되자 프로젝트가 완전히 사용 불가 상태가 되었고, 오류 메시지(“You’re out of extra usage”)에는 콘텐츠 기반 라우팅이 원인이라는 어떠한 힌트도 없었습니다.

재현 방법

재현은 간단합니다:

HERMES.md를 커밋 메시지에 포함하여 git 저장소 생성- Claude Code 실행 시 “You’re out of extra usage” 오류 발생

Anthropic의 대응

유지 관리자 ThariqS는 문제를 인지하였음을 확인하고, 영향받은 사용자들에게 환불 및 추가 1개월 크레딧($200)을 이메일로 통지하기로 하였습니다.

근본적인 문제점

API 요청 청구는 절대로 git 커밋 메시지의 내용에 따라 달라져서는 안 됩니다. Max 플랜 구독자의 모든 요청은 저장소 히스토리와 무관하게 포함된 플랜 할당량으로 먼저 라우팅되어야 합니다. 이 버그는 HN에서 큰 반향을 일으키며 Anthropic이 신속히 대응하게 만들었습니다.

[2026-04-30 / Top 2] Vibe의 원격 에이전트. Mistral Medium 3.5로 구동.

Mistral AI의 128B 밀집 모델과 클라우드 기반 코딩 에이전트 출시

원본 기사: https://mistral.ai/news/vibe-remote-agents-mistral-medium-3-5

Mistral Medium 3.5 및 Vibe 원격 에이전트 발표

Mistral AI가 2026년 4월 29일, 세 가지 주요 발표를 동시에 내놓았습니다: Mistral Medium 3.5 모델, Vibe 원격 에이전트, 그리고 Le Chat Work Mode입니다.

Mistral Medium 3.5

Mistral의 첫 번째 플래그십 통합 모델로, 단일 가중치 세트에서 명령어 이해, 추론, 코딩을 모두 처리하는 128B 밀집 모델입니다.

주요 사양:

- 컨텍스트 윈도우: 256k 토큰

- 벤치마크: SWE-Bench Verified에서 77.6% 달성

- 비전: 처음부터 학습된 비전 인코더가 다양한 이미지 크기와 비율 처리

- 가변 추론: 요청별로 추론 노력을 설정 가능하여 빠른 답변부터 심층 사고까지 대응

- 배포: 최소 4개의 GPU로 자체 호스팅 가능

- 라이선스: 수정 MIT 라이선스로 오픈 웨이트 공개

이전 모델인 Devstral 2, Qwen3.5 397B A17B를 코딩 및 에이전트 벤치마크에서 능가합니다.

Vibe 원격 코딩 에이전트

기존 코딩 에이전트가 로컬 환경에서만 동작하던 한계를 넘어, Mistral은 이를 클라우드로 이동시켰습니다. Vibe 원격 에이전트는:

- 비동기 실행: 백그라운드에서 독립적으로 실행되며 완료 시 알림

- 병렬 처리: 여러 에이전트가 동시에 실행 가능

- 시작 방법: Mistral Vibe CLI 또는 Le Chat에서 직접 시작

- 클라우드 이전: 로컬 CLI 세션을 클라우드로 “텔레포트” 가능

- 결과물: GitHub Pull Request 형태로 완성된 코드 제출

Le Chat Work Mode

Le Chat의 새로운 Work Mode(미리보기)는 복잡한 멀티스텝 작업을 위한 강력한 에이전트를 제공합니다. 이메일 분류, 리서치 합성, 크로스 도구 작업 등 복잡한 업무 흐름을 처리할 수 있습니다.

의의

Mistral Medium 3.5는 클로즈드 모델에 대한 의존 없이 기업급 AI 성능을 자체 인프라에서 구현할 수 있는 가능성을 보여줍니다. 특히 코딩 에이전트의 클라우드 이전은 AI 개발 환경의 새로운 패러다임을 제시하고 있습니다.

[2026-04-30 / Top 1] Zed가 1.0이 되다

Rust와 GPU로 구동하는 코드 에디터의 정식 버전 출시

원본 기사: https://zed.dev/blog/zed-1-0

Zed 1.0 정식 출시

Rust로 작성된 GPU 가속 코드 에디터 Zed가 마침내 버전 1.0에 도달했습니다. Atom 에디터를 만든 팀이 새롭게 선보이는 이 에디터는, 기존 Electron 기반 에디터의 한계를 뛰어넘기 위해 처음부터 다시 설계되었습니다.

GPUI: 비디오 게임처럼 만들어진 UI 프레임워크

Zed 팀은 웹 페이지 방식 대신 비디오 게임처럼 에디터를 구축했습니다. 전체 애플리케이션을 GPU 셰이더에 데이터를 공급하는 구조로 설계하여, Rust로 자체 UI 프레임워크인 GPUI를 처음부터 작성했습니다. 그 결과:

- 일관된 120 FPS 렌더링

- VS Code 대비 10배 빠른 시작 속도 (0.12초 vs 1.2초)

- VS Code 대비 16배 적은 메모리 사용량 (222MB vs 3,549MB)

- 체감할 수 있는 입력 지연 단축 (2ms vs 25ms)

주요 기능

AI 통합: 병렬 에이전트, 편집 예측, Agent Client Protocol(Claude, Codex, OpenCode, Cursor 지원)을 포함합니다. Zed의 AI는 확장 프로그램으로 추가된 것이 아니라 코어에 내장되어 있습니다.

실시간 협업: 여러 사람이 동일한 파일을 실시간으로 편집하고 서로의 커서를 따라갈 수 있습니다. 팀은 CRDT 기반 동기화 엔진 DeltaDB를 개발 중으로, 사람과 AI 에이전트가 코드베이스의 일관된 뷰를 공유할 수 있게 됩니다.

멀티플랫폼 지원: macOS, Windows, Linux에서 사용 가능하며, Git 통합, SSH 원격 접속, 디버깅, 언어 도구 등을 내장하고 있습니다.

Zed for Business: 팀을 위한 중앙화된 청구, 역할 기반 접근 제어, 조직 관리 기능을 제공하는 Zed for Business도 함께 발표되었습니다.

Zed의 의미

이번 1.0 출시는 단순한 버전 번호 이상의 의미를 가집니다. Electron 시대의 종말과 함께, 네이티브 성능과 현대적인 개발 경험을 동시에 추구하는 새로운 에디터 시대의 시작을 알리는 이정표입니다. HN에서 528개의 댓글이 달릴 만큼 개발자 커뮤니티의 뜨거운 반응을 받았습니다.

[2026-04-29 / Top 10] OpenAI CEO의 신원 인증 회사, 가짜 브루노 마스 파트너십 발표

Tools for Humanity, '착각'으로 인해 존재하지 않는 Bruno Mars 투어 파트너십 발표

요약

OpenAI CEO 샘 알트만(Sam Altman) 이 공동창업한 신원 인증 스타트업 Tools for Humanity가 샌프란시스코 론칭 이벤트에서 브루노 마스(Bruno Mars)의 월드 투어와 파트너십을 맺었다고 발표했습니다. 그러나 브루노 마스 측과 공연 주관사 Live Nation은 “그런 논의 자체가 없었다”며 즉각 부인했습니다.

무슨 일이 있었나?

Tools for Humanity 임원들은 론칭 이벤트에서 자사의 World ID 기반 신원 인증 서비스가 브루노 마스의 다가오는 월드 투어에 적용될 예정이라고 발표했습니다. 검증된 사용자들에게 독점 접근권과 VIP 경험을 제공할 것이라는 내용이었습니다.

브루노 마스 측의 반응

브루노 마스의 매니지먼트와 Live Nation은 즉각 성명을 발표했습니다:

“분명히 말하지만, 우리는 한 번도 접근을 받은 적이 없고, 파트너십이나 투어 접근에 관한 어떤 논의도 한 적이 없습니다.”

Tools for Humanity의 해명

회사 측은 브루노 마스에 대한 언급이 “팀 내부의 잘못된 커뮤니케이션(miscommunication)” 에서 비롯됐다고 해명했습니다.

실제 파트너십은 브루노 마스가 아닌 Thirty Seconds to Mars(30 seconds to Mars) 와의 2027년 유럽 투어 건이었으며, 두 아티스트의 이름이 혼동된 것으로 보입니다.

Tools for Humanity와 World ID란?

Tools for Humanity는 샘 알트만이 2019년 공동창업한 회사로, World ID 서비스를 통해 AI 봇과 구분되는 “진짜 인간임을 증명”하는 솔루션을 제공합니다. 사용자의 홍채를 스캔하는 Orb 장치를 활용합니다.

현재 Zoom, DocuSign, Tinder 등과 협력하고 있으며, 최근에는 모바일 Orb Mini 기기도 출시했습니다.

반응과 시사점

이 사건은 AI 시대 신원 인증의 중요성을 강조하려는 시도가 오히려 기본적인 사실 확인 실패로 역효과를 낳은 아이러니한 사례로 주목받고 있습니다. AI 봇을 구분하겠다는 서비스가 정작 파트너십 아티스트의 이름조차 제대로 확인하지 못했다는 점에서 비판이 제기됩니다.

[2026-04-29 / Top 8] GitHub 가용성 업데이트

머지 큐 커밋 오염, 검색 서비스 다운 등 4월 장애 두 건에 대한 공식 설명

원본 기사: https://github.blog/news-insights/company-news/an-update-on-github-availability/

요약

GitHub가 2026년 4월에 발생한 두 건의 주요 장애에 대한 공식 업데이트를 게시했습니다. 머지 큐(Merge Queue) 커밋 오염 문제와 Elasticsearch 검색 다운 사고에 대해 원인과 영향을 설명하고, 향후 인프라 확장 계획도 밝혔습니다.

사고 1: 머지 큐 커밋 오염 (4월 23일)

무슨 일이 있었나? 머지 큐의 squash merge 방식에서 회귀(regression)가 발생했습니다. 두 개 이상의 PR이 동일한 머지 그룹에 포함될 경우, 이전에 병합된 PR의 변경사항이 이후 머지에 의해 실수로 되돌려지는(reverted) 문제가 생겼습니다.

영향 범위:

- 영향을 받은 저장소: 658개

- 영향을 받은 PR: 2,092건

(GitHub의 초기 발표 수치가 다소 높았던 것은 첫 평가를 보수적으로 잡았기 때문이라고 설명)

사고 2: Elasticsearch 검색 서비스 다운 (4월 27일)

GitHub 검색을 지원하는 Elasticsearch 클러스터가 과부하 상태에 빠졌습니다. 원인은 봇넷 공격으로 추정되며, 클러스터가 응답 불능이 되어 GitHub 내 검색 기반 기능들이 일시 중단됐습니다.

GitHub 인프라의 현재 상황

급격한 성장 압력:

- 2025년 12월 하반기부터 에이전틱(agentic) 개발 워크플로우가 급격히 증가

- 저장소 생성, PR 활동, API 사용량, 자동화, 대형 저장소 작업 부하 모두 빠르게 증가

확장 계획:

- 2025년 10월, 현재 대비 10배 용량 확장 계획 시작

- 그러나 2026년 2월, 30배 규모의 확장이 필요하다는 판단으로 계획 수정

시사점

이번 사고는 개발자 도구인 GitHub 자체의 신뢰성 문제를 다시 수면 위로 올렸습니다. 특히 AI 코딩 에이전트의 폭발적인 증가로 GitHub 인프라에 전례 없는 부하가 가해지고 있으며, 이에 대한 충분한 대비가 필요한 상황입니다.

[2026-04-29 / Top 7] VibeVoice: 마이크로소프트의 오픈소스 최첨단 음성 AI

60분 장문 오디오를 단일 패스로 처리하는 TTS/ASR 통합 음성 AI 모델

요약

Microsoft가 오픈소스 음성 AI 모델 시리즈 VibeVoice를 공개했습니다. TTS(텍스트→음성)와 ASR(음성→텍스트) 모델을 모두 포함하며, 특히 60분 장문 오디오를 단일 패스로 처리하는 ASR 기능이 주목을 받고 있습니다.

주요 모델

VibeVoice-ASR (음성 인식)

- 60분 장문 오디오 단일 패스 처리

- 구조화된 전사 결과 생성: 누가(화자), 언제(타임스탬프), 무엇을(내용) 포함

- 사용자 맞춤 컨텍스트 지원

- 50개 이상 언어 지원 (네이티브 다국어)

- 2026년 1월 21일 오픈소스 공개

VibeVoice-Realtime-0.5B (실시간 TTS)

- 스트리밍 텍스트 입력 지원

- 견고한 장문 음성 생성

- 실시간 처리에 최적화된 경량 모델

핵심 기술

VibeVoice의 핵심 혁신은 연속 음성 토크나이저(Continuous Speech Tokenizer) 입니다:

- 초저프레임율 7.5Hz로 동작하는 음향(Acoustic) 및 의미(Semantic) 토크나이저

- 오디오 품질을 유지하면서 긴 시퀀스 처리의 연산 효율을 크게 향상

- 기존 모델 대비 긴 오디오 처리 성능 개선

커뮤니티 활용

- Vibing: VibeVoice-ASR 기반의 음성 입력 방식 앱 (2026년 3월 29일 공개)

- 커뮤니티 포크

vibevoice-community/VibeVoice도 활발히 개발 중 - 모델 가중치는 Hugging Face에서 공개 제공 (

microsoft/VibeVoice-1.5B)

접근 방법

- GitHub: microsoft/VibeVoice

- 공식 문서: microsoft.github.io/VibeVoice

- 모델 다운로드: Hugging Face에서 제공

[2026-04-29 / Top 6] 생리 주기 앱 Flo, 사용자 데이터를 Meta에 판매한 것으로 밝혀져

캘리포니아 배심원단, Meta가 여성 건강 데이터를 불법 수집했다고 평결

원본 기사: https://femtechdesigndesk.substack.com/p/your-period-tracking-app-has-been

요약

생리 주기 추적 앱 Flo Health가 사용자들에게 “제3자와 절대 공유하지 않는다”고 약속했던 민감한 건강 데이터를 Meta(Facebook)에 제공해온 것이 밝혀졌습니다. 캘리포니아 배심원단은 Meta가 캘리포니아 개인정보 침해법을 위반했다고 만장일치로 평결했습니다.

어떻게 데이터가 유출됐나?

Flo 앱에는 SDK(소프트웨어 개발 키트) 형태로 제3자 코드가 내장되어 있었으며, 이를 통해 사용자가 앱 내 설문에 입력한 모든 정보(월경 주기, 임신 여부, 건강 상태 등)가 Meta로 자동 전송됐습니다.

Meta는 이 데이터를 광고 타겟팅에 활용했습니다.

문제가 된 Flo의 약속

Flo Health는 사용자들에게 다음을 보장했습니다:

- 제공한 정보는 비공개로 유지됩니다

- 명시적 동의 없이 제3자와 공유하지 않습니다

하지만 실제로는 SDK를 통해 민감한 데이터가 Facebook, Google, Appflyer, Flurry 등에 공유되고 있었습니다.

사건 경위

- 2019년 2월: 월스트리트저널(WSJ)의 보도로 처음 폭로

- 2019년 이후: 여러 집단 소송 제기

- 2021년: Flo의 데이터 공유 관행 중단

- 재판 결과: Meta는 합의를 거부하고 배심원 재판까지 진행, 결국 캘리포니아 개인정보 침해법 위반 판결을 받음

더 넓은 시사점

이 사건은 여성 건강 데이터 프라이버시의 심각성을 다시 한번 부각시킵니다. 생리 주기, 임신 여부 등의 데이터는 극도로 민감한 정보임에도 불구하고, 앱에 내장된 제3자 SDK를 통해 광고 기업들로 무분별하게 흘러갈 수 있다는 점이 문제입니다.

피해자들은 최종적으로 350만 달러 규모의 합의금을 받게 됐습니다.

[2026-04-29 / Top 5] GTFOBins: 리눅스 권한 상승을 위한 유닉스 바이너리 모음

보안 전문가와 침투 테스터를 위한 유닉스 바이너리 악용 기법 데이터베이스

원본 기사: https://gtfobins.org/

요약

GTFOBins(Get The F** Out Binaries*)는 잘못 구성된 시스템에서 로컬 보안 제한을 우회하는 데 악용될 수 있는 유닉스 바이너리들을 큐레이션한 프로젝트입니다. 보안 연구자, 시스템 관리자, 침투 테스터들에게 필수적인 참고 자료입니다.

GTFOBins란?

GTFOBins는 커뮤니티 기반 프로젝트로, 정상적인 용도가 있는 유닉스 바이너리들이 어떻게 보안 제한을 우회하는 데 악용될 수 있는지 정리한 데이터베이스입니다. 각 항목은:

- 바이너리의 위치

- 실행에 필요한 권한

- 권한 상승에 악용하는 방법과 예제

를 제공합니다.

주요 활용 분야

- 제한된 셸 탈출(Shell Escape): 제한된 환경에서 일반 셸을 획득하는 방법

- 권한 상승(Privilege Escalation): 일반 사용자에서 root 권한 획득

- SUID/SUDO 바이너리 악용: 잘못 설정된 sudo 권한이나 SUID 비트 악용

- 파일 전송: 서버 간 파일 이동에 활용 가능한 바이너리

- 리버스 쉘/바인드 쉘: 네트워크 연결을 통한 원격 쉘 획득

- 역량(Capabilities) 악용: 잘못 설정된 Linux capabilities 활용

보안 관점에서의 의미

GTFOBins는 공격자의 도구일 뿐 아니라 방어자에게도 중요한 리소스입니다:

- 시스템의 잠재적 취약점을 파악하고 사전에 조치하는 데 도움

- sudo 권한 설정 감사(Audit) 시 참고 자료

- 보안 교육 및 CTF(Capture The Flag) 대회에 널리 활용

데이터베이스는 지속적으로 업데이트되어 새로운 바이너리와 기법이 추가됩니다.

대표적인 악용 가능 바이너리 예시

find, vim, python, perl, bash, less, tar, git 등 일상적으로 사용하는 유틸리티들도 잘못 설정된 환경에서는 권한 상승에 악용될 수 있습니다. GTFOBins는 이런 바이너리들의 실제 악용 예제를 제공합니다.

[2026-04-29 / Top 4] UAE, OPEC 탈퇴 선언

약 60년 만에 UAE가 OPEC을 떠나 독자 생산 전략을 추구

원본 기사: https://www.ft.com/content/8c354f2d-3e66-47f1-aad4-9b4aa30e386d

요약

아랍에미리트(UAE) 가 2026년 4월 28일, OPEC 및 OPEC+ 탈퇴를 공식 발표했습니다. 탈퇴는 2026년 5월 1일부터 효력을 가지며, 약 60년의 회원국 역사가 막을 내리게 됩니다.

탈퇴 이유

UAE는 “국익과 시장의 긴급한 수요를 효과적으로 충족하기 위한 생산 정책의 포괄적 검토” 결과라고 설명했습니다. 구체적인 배경은 다음과 같습니다:

- 생산 쿼터 제한 불만: UAE의 생산 능력은 하루 480만 배럴에 달하지만, OPEC 합의에 따라 실제 생산량은 하루 320만 배럴로 제한되어 있었습니다.

- 2027년 목표: UAE는 2027년까지 일일 생산 능력을 500만 배럴로 늘리겠다는 목표를 갖고 있어, OPEC의 쿼터 체제와 충돌했습니다.

- 호르무즈 해협 위기: 미국-이스라엘의 이란 공격 이후 이란이 호르무즈 해협에서의 선박 공격을 이어가며 UAE의 원유 수출이 심각하게 제약됐습니다.

에너지 시장에 미치는 영향

- OPEC의 생산량 규제 협력 체계에 중대한 균열 발생

- 사우디아라비아 주도의 OPEC+ 생산 감산 공조에 타격

- UAE의 독자 증산 가능성으로 국제 유가 하락 압력 예상

- 다른 걸프 산유국들의 연쇄 탈퇴 가능성도 제기됨

배경: OPEC이란?

OPEC(석유수출국기구)은 1960년 설립된 국제기구로, 회원국들이 원유 생산량을 조율해 시장 안정과 가격 지지를 목표로 합니다. UAE는 1967년 OPEC에 가입한 이후 약 60년간 회원국 지위를 유지해 왔습니다.

[2026-04-29 / Top 3] Localsend: AirDrop의 오픈소스 크로스플랫폼 대안

인터넷 없이 로컬 네트워크로 안전하게 파일을 공유하는 무료 앱

요약

LocalSend는 무료 오픈소스 앱으로, 인터넷 연결 없이 로컬 네트워크를 통해 주변 기기와 파일 및 메시지를 안전하게 공유할 수 있습니다. Apple의 AirDrop과 Google의 Quick Share를 대체하는 크로스플랫폼 솔루션입니다.

주요 특징

- 완전 크로스플랫폼: Windows, macOS, Linux, Android, iOS 모두 지원

- 로컬 네트워크 전용: 인터넷 불필요, 같은 Wi-Fi 또는 이더넷 네트워크 내에서 작동

- 엔드-투-엔드 암호화: REST API와 HTTPS 암호화 사용

- 중앙 서버 없음: 파일이 서버를 거치지 않아 데이터 프라이버시 보장

편의 기능

- 다양한 공유 형식: 파일, 폴더, 텍스트, 클립보드 내용 공유 지원

- 즐겨찾기 기기: 자주 연결하는 기기를 즐겨찾기로 저장 가능

- PIN 보호: 수신 시 PIN 인증으로 보안 강화

- 링크/QR 코드: LocalSend가 설치되지 않은 기기와도 링크나 QR 코드로 공유 가능

AirDrop과의 비교

| 항목 | AirDrop | LocalSend |

|---|---|---|

| 플랫폼 | Apple 기기 전용 | 모든 OS |

| 오픈소스 | X | O |

| 무료 | O | O |

| 인터넷 필요 | X | X |

| 서버 경유 | X | X |

한계

같은 네트워크(Wi-Fi 또는 이더넷)에 연결된 기기 간에만 작동합니다. 다른 네트워크의 기기와는 링크/QR 코드 방식을 이용해야 합니다.

GitHub에서 오픈소스로 개발되고 있으며, 현재 HN에서 다시 큰 주목을 받고 있습니다.

[2026-04-29 / Top 2] 당신의 스마트폰이 곧 당신의 것이 아니게 된다

Google, 2026년 9월부터 미등록 앱 설치 전면 차단 예정

요약

Keep Android Open 캠페인이 주목을 받고 있습니다. 2025년 8월 Google이 발표한 새로운 정책에 따르면, 2026년 9월부터 Google에 사전 등록하지 않은 개발자의 앱은 Android 기기에 설치할 수 없게 됩니다. 이 조치는 공식 Play Store뿐만 아니라 사이드로딩, F-Droid, 개인 제작 앱까지 모두 적용됩니다.

새로운 Google 정책의 핵심

- 등록 의무화: 2026년 9월부터 모든 Android 앱 개발자는 Google에 중앙 등록을 마쳐야 합니다.

- 정부 신분증 제출 필요: 개발자는 정부 발급 신분증을 제출하고, 수수료를 납부하며, Google의 약관에 동의해야 합니다.

- 자동 차단: 등록하지 않은 개발자의 앱은 사용자 동의 없이 자동으로 차단됩니다.

영향 범위

이 정책은 단순히 Play Store 앱에만 적용되는 것이 아닙니다:

- 친구들 사이에서 공유하는 앱

- F-Droid 등 대안 앱 스토어의 수천 개 무료 오픈소스 앱

- 취미로 자신의 기기를 위해 만든 개인 앱

F-Droid는 이 정책을 “실존적 위협” 이라고 표현했습니다.

우려되는 문제들

- 개인정보: 개발자의 신분 정보가 Google에 집중됩니다.

- 검열 가능성: 정부가 특정 앱을 삭제 요청하기 더 쉬워집니다.

- 개방형 생태계 훼손: Android의 핵심 가치인 개방성이 사라질 수 있습니다.

- 소규모 개발자 위축: 수수료와 관료적 절차가 신규 개발자 진입 장벽을 높입니다.

Keep Android Open 캠페인

keepandroidopen.org 는 이 정책에 반대하는 서명 운동을 진행 중입니다. 사용자와 개발자들이 Android의 개방성 유지를 Google에 촉구하고 있습니다.

[2026-04-29 / Top 1] Ghostty, GitHub를 떠나다

HashiCorp 공동창업자, GitHub가 '진지한 작업을 위한 공간이 아니다'라며 이주 선언

요약

터미널 에뮬레이터 Ghostty의 개발자이자 HashiCorp 공동창업자인 Mitchell Hashimoto가 Ghostty 프로젝트를 GitHub에서 이주하겠다고 공식 발표했습니다. GitHub의 빈번한 장애와 신뢰성 문제로 인해 더 이상 생산적인 개발이 불가능하다는 것이 핵심 이유입니다.

이주 결정의 배경

Hashimoto는 자신이 GitHub 사용자 번호 1299번(2008년 2월 가입)으로, 플랫폼에 깊은 애착을 갖고 있음에도 결단을 내렸다고 밝혔습니다. 그는 다음과 같이 심경을 토로했습니다:

“나는 거기 있고 싶지만, 플랫폼이 나를 원하지 않는 것 같다. 일하고 싶은데 일을 못 하게 한다. 소프트웨어를 출시하고 싶은데 그러지 못하게 한다. 더 이상 GitHub로는 코딩을 할 수 없다.”

구체적인 문제들

- GitHub Actions 장애: 3월 5일, GitHub Actions가 3시간 이상 성능 저하 상태를 유지했으며, 워크플로우 실행의 95% 가 5분 내 시작되지 않았습니다.

- 느린 PR 처리: Pull Request 로드 속도가 현저히 느려지고, 일부 경우 코드 머지가 아예 불가능했습니다.

- 핵심 인프라 방치: GitHub가 AI 기능(Copilot)에 집중하는 동안 Issues, Pull Requests, Actions 등 핵심 협업 기능의 품질이 저하됐다는 비판입니다.

이주 계획

- Ghostty의 GitHub 저장소는 즉시 삭제되지 않으며, 읽기 전용 미러로 유지됩니다.

- 이주는 점진적으로 진행되며, 새로운 플랫폼은 아직 공개적으로 결정되지 않았습니다.

- Hashimoto는 Ghostty가 자신과 메인테이너, 오픈소스 커뮤니티 모두가 가장 큰 영향을 받는 프로젝트이기 때문에 이번 변경의 중심으로 삼는다고 설명했습니다.

의미와 파장

이번 결정은 GitHub의 인프라 신뢰성 문제를 공개적으로 제기하는 데 큰 반향을 일으키고 있습니다. 특히 오픈소스 생태계에서 GitHub에 대한 의존도가 높아진 상황에서, 대안 플랫폼에 대한 논의가 다시금 촉발되고 있습니다.

[2026-04-28 / Top 10] GitHub 현재 장애 발생

2026년 4월 28일, GitHub 여러 서비스에 장시간 장애가 발생했습니다

원본 기사: https://www.githubstatus.com

개요

2026년 4월 28일, GitHub의 여러 핵심 서비스에 동시다발적인 장애가 발생했습니다. GitHub Actions, GitHub Issues 등 주요 기능이 수 시간에서 수십 시간에 걸쳐 중단 또는 저하되었으며, 전 세계 개발자들이 업무에 차질을 빚었습니다.

장애 현황

장애는 복수의 서비스에 걸쳐 다양한 심각도로 발생했습니다:

| 서비스 | 상태 | 지속 시간 |

|---|---|---|

| 일반 서비스 | 경고 | 약 4시간 25분 |

| GitHub Actions | 다운 | 약 14시간 6분 |

| GitHub Issues | 다운 | 약 20시간 24분 |

오후 2시 1분경 일부 서비스 중단이 시작되었고, 2시 21분경에는 저장소 내 풀 리퀘스트 결과 불완전 표시 및 GitHub 검색 저하가 보고되었습니다.

사용자 반응

DownDetector 등 장애 추적 서비스에 따르면, 오전 9시 5분(CET 기준) 전후로 사용자 신고가 급증했습니다. 소셜 미디어에서는 GitHub 접근 문제를 호소하는 개발자들의 글이 쏟아졌습니다.

HN 커뮤니티 반응

Hacker News에 “GitHub is having issues now”라는 단순한 제목의 게시글이 올라오자, 많은 개발자들이 실시간으로 상황을 공유하며 댓글로 장애 범위와 회피 방법을 논의했습니다. 일부는 GitLab 등 대안 플랫폼으로의 일시적 전환을 언급하기도 했습니다.

GitHub 장애 모니터링

GitHub의 실시간 서비스 상태는 githubstatus.com에서 확인할 수 있으며, 과거 인시던트 이력도 열람 가능합니다.

[2026-04-28 / Top 9] 중국, 메타의 AI 스타트업 Manus 인수 차단

중국 국가발전개혁위원회가 메타의 20억 달러 규모 AI 에이전트 개발사 Manus 인수를 금지했습니다

원본 기사: https://www.cnbc.com/2026/04/27/meta-manus-china-blocks-acquisition-ai-startup.html

개요

중국 국가발전개혁위원회(NDRC)가 메타(Meta)의 AI 에이전트 개발사 Manus 인수를 공식 차단했습니다. 메타는 지난해 12월 싱가포르에 본사를 둔 AI 스타트업 Manus를 20억 달러에 인수하겠다고 발표했으나, 중국 당국의 규제 심사 끝에 거래 철회를 요구받았습니다.

Manus란?

Manus는 2025년 3월 출시되어 중국 관영 언론에서 “차세대 딥시크(DeepSeek)”로 불린 AI 에이전트 서비스입니다. 베이징의 기술 기업 ‘베이징 레드버터플라이 테크놀로지(Beijing Red Butterfly Technology)’가 개발했으며, 2025년 7월 싱가포르로 법인을 이전했습니다.

차단 배경

중국 정부는 2026년 1월부터 이 거래에 대한 조사를 시작했습니다. NDRC는 법률 및 규정에 따라 Manus에 대한 외국인 투자를 금지하기로 결정했으며, 거래 당사자들에게 철회를 요구했습니다.

지정학적 의미

이번 결정은 중국이 AI 기술 민족주의를 강화하고 있음을 보여줍니다:

- 싱가포르 법인화의 한계: 법인을 싱가포르로 이전하는 것만으로는 중국의 규제 범위를 벗어날 수 없다는 신호를 보냈습니다.

- AI 스타트업 경고: 해외로 데이터, 인재, 지식재산을 이전하려는 중국 스타트업에 대한 강력한 경고로 해석됩니다.

- 미·중 AI 경쟁: 미국과 중국이 AI 기술 주도권을 놓고 점점 더 갈등하고 있음을 단적으로 보여주는 사례입니다.

전망

메타 측은 이번 결정에 크게 실망했으나, 중국의 결정을 수용했습니다. 전문가들은 앞으로 중국계 AI 스타트업을 대상으로 한 미국 빅테크 기업들의 인수합병이 더욱 어려워질 것으로 전망하고 있습니다.

[2026-04-28 / Top 8] Show HN: 내가 만든 오픈소스 에이전트, Gemini-3-flash-preview로 TerminalBench 1위 달성

토큰 효율성에 집중한 코딩 에이전트 Dirac이 TerminalBench 2.0에서 최고 점수를 기록했습니다

개요

개발자 Max Trivedi가 만든 오픈소스 코딩 에이전트 Dirac이 TerminalBench 2.0 리더보드에서 65.2%의 점수로 1위를 달성했습니다. 이는 Google의 공식 기준선(47.6%)과 당시 최고 성능의 상용 에이전트 Junie CLI(64.3%)를 모두 능가하는 성과입니다.

Dirac 소개

Dirac은 효율성과 컨텍스트 큐레이션에 집중하는 코딩 에이전트입니다. 주요 특징:

- 비용 절감: 다른 에이전트 대비 API 비용 50~80% 절감 (2.8배 저렴)

- Hash Anchored 편집: 파일 전체를 읽고 쓰는 대신 해시 기반으로 필요한 부분만 수정

- 대규모 병렬 작업: 여러 작업을 동시에 처리

- AST 조작: 추상 구문 트리 기반의 정확한 코드 수정

- 승인 기반 워크플로: 파일 읽기/쓰기, 터미널 명령 실행, 헤드리스 브라우저 사용 등 모든 동작에 사용자 승인 요청

벤치마크 성과

| 에이전트 | TerminalBench 2.0 점수 |

|---|---|

| Dirac (Gemini-3-flash-preview) | 65.2% |

| Junie CLI | 64.3% |

| Google 공식 기준선 | 47.6% |

개발자는 어떠한 에이전트/스킬 힌트 파일도 삽입하지 않았고 치팅 메커니즘도 사용하지 않았다고 밝혔습니다.

설치

VS Code Marketplace에서 확장 프로그램으로 설치할 수 있으며, GitHub 저장소에서 소스 코드를 직접 확인할 수 있습니다.

[2026-04-28 / Top 7] 네덜란드 중앙은행, AWS 버리고 유럽 클라우드로 리들 선택

네덜란드 중앙은행이 미국 클라우드 의존도를 줄이기 위해 리들 모회사의 유럽 클라우드 Stackit을 선택했습니다

개요

네덜란드 중앙은행(De Nederlandsche Bank, DNB)이 AWS를 떠나 유럽 클라우드 플랫폼 Stackit을 채택하기로 결정했습니다. Stackit은 유럽 최대 할인 슈퍼마켓 체인 리들(Lidl)과 카우플란트(Kaufland)의 모기업인 슈바르츠 그룹(Schwarz Group)의 IT 부문인 슈바르츠 디지츠(Schwarz Digits)가 운영하는 클라우드 플랫폼입니다.

선택 이유

미국 클라우드 의존도 탈피: DNB는 AWS, 애저, 구글 클라우드 등 미국 클라우드 제공업체에 대한 의존이 지정학적 리스크를 초래한다고 판단했습니다. 이들 서비스는 미국 클라우드법(CLOUD Act) 적용을 받기 때문에 미국 정부가 데이터에 접근할 가능성이 있습니다.

금융 규제 당국의 경고: 작년 네덜란드 중앙은행(DNB)과 네덜란드 금융시장 감독국(AFM)은 네덜란드 금융 부문이 외국(특히 미국) IT 서비스 제공업체에 지나치게 의존하고 있다고 경고한 바 있습니다.

유럽 데이터 주권: Schwarz Digits의 Stackit은 모든 데이터가 유럽 법률의 적용을 받는 주권 클라우드를 구축하는 것을 목표로 하고 있습니다.

솔직한 인정

DNB 이사 Steven Maijoor는 유럽 클라우드 대안이 아직 미국 경쟁사만큼 성숙하거나 고품질이지 않다는 점을 솔직히 인정했습니다. 그럼에도 불구하고 지정학적 리스크 감소를 우선시하는 전략적 결정임을 강조했습니다.

의미

이번 결정은 유럽 금융기관들의 디지털 주권에 대한 인식이 높아지고 있음을 보여줍니다. 유럽에서 “슈퍼마켓 클라우드”가 금융 인프라의 대안으로 진지하게 고려되고 있다는 사실 자체가 기술 분야에서 지정학이 미치는 영향을 단적으로 보여줍니다.

[2026-04-28 / Top 6] 내가 보는 파란색이 당신의 파란색과 같을까?

신경과학자가 만든 색 인식 테스트로 파란색과 초록색의 경계를 탐구합니다

원본 기사: https://ismy.blue/

개요

신경과학자이자 AI 연구자 Patrick Mineault이 만든 인터랙티브 색 인식 테스트 사이트 ismy.blue가 다시 Hacker News 상위권에 올랐습니다. 이 사이트는 파란색과 초록색의 경계를 어디서 인식하는지 테스트하고, 결과를 전 세계 다른 사람들과 비교할 수 있게 해줍니다.

테스트 방법

화면 전체를 하나의 색으로 채우고, 사용자에게 “파란색인가요, 초록색인가요?”를 묻습니다. 색상이 점점 중간 단계로 변하면서 사용자가 파랑과 초록의 경계를 어디서 인식하는지 측정합니다. 테스트가 끝나면 본인의 경계점이 전체 응답자 평균 대비 어디에 위치하는지 백분율로 보여줍니다.

색 인식의 주관성

우리가 “파란색”이라고 부르는 색을 다른 사람도 동일하게 경험하는지는 철학적·신경과학적 난제입니다. 이 테스트는 언어, 문화, 환경이 색 인식에 미치는 영향을 탐구합니다. 실제로 러시아어에는 파란색을 두 단어(연한 파랑 ‘goluboy’, 진한 파랑 ‘siniy’)로 구분하며, 러시아어 화자는 영어 화자보다 파랑 계열 색상을 더 빠르게 구별하는 경향이 있다는 연구도 있습니다.

주의 사항

색 인식에는 다음 요소들이 영향을 미칩니다:

- 기기 종류 및 노후화 정도

- 디스플레이 설정 및 주변 조명

- 하루 중 시간대

- 테스트에서 색상이 제시되는 순서

따라서 결과는 절대적인 수치가 아닌 상대적 비교로 해석해야 합니다.

인기

출시 직후 약 한 달 만에 150만 건 이상의 방문을 기록했으며, 색상 인식의 주관성에 대한 대중적 관심을 이끌어냈습니다.

[2026-04-28 / Top 5] Pgbackrest, 유지보수 종료

13년간 PostgreSQL 백업 솔루션으로 사용되어 온 pgBackRest 프로젝트가 아카이브 처리되었습니다

개요

PostgreSQL을 위한 대표적인 백업 및 복원 솔루션인 pgBackRest가 2026년 4월 27일부로 공식적으로 유지보수를 종료하고 저장소를 아카이브(읽기 전용)로 전환했습니다. 13년간 개발되어 왔으며 현재 최종 안정 릴리스는 2026년 1월에 출시된 v2.58.0입니다.

종료 이유

개발자 David Steele은 LinkedIn과 GitHub을 통해 공개한 성명에서 Crunchy Data가 매각된 이후 개인 자격으로 프로젝트를 유지하며 재정적으로 지속 가능한 자리를 찾으려 했지만 성공하지 못했다고 밝혔습니다. 스폰서십 확보 노력도 프로젝트 운영에 필요한 수준에 크게 못 미쳤다고 설명했습니다.

커뮤니티 반응

pgBackRest는 PostgreSQL 생태계에서 널리 사용되는 백업 솔루션이었기 때문에 커뮤니티의 충격이 큽니다. 현재 다음과 같은 대안들이 논의되고 있습니다:

- Percona의 지원 지속: Percona는 pgBackRest를 계속 지원하겠다고 밝혔으며, 다른 조직들과의 협력 구조를 논의 중입니다.

- 재단 기반 프로젝트 설립: 독립적인 재단의 후원을 받는 프로젝트로 전환하는 방안

- 다중 벤더 관리 모델: 여러 회사가 공동으로 유지보수를 담당하는 구조

- PostgreSQL 코어 통합: 핵심 기능을 PostgreSQL 생태계에 더 가깝게 이전하는 방안

마이그레이션 고려사항

pgBackRest를 현재 사용 중인 팀은 장기적인 대안을 검토해야 합니다. 주요 대안으로는 Barman, wal-g, pg_dump 등이 있으며, 각 솔루션의 기능 비교 및 마이그레이션 경로를 미리 파악해두는 것이 좋습니다.

[2026-04-28 / Top 4] Mercor AI 계약자 4만 명의 음성 샘플 4TB 탈취

해킹 그룹 Lapsus$가 AI 훈련 플랫폼 Mercor에서 4만 명의 음성 및 신원 데이터를 유출했습니다

개요

해킹 그룹 Lapsus$가 AI 데이터 라벨링 플랫폼 Mercor에서 4만 명 이상의 AI 계약자 음성 샘플 및 신원 정보를 담은 약 4TB 규모의 데이터를 탈취했습니다. 이번 침해는 음성 생체 인식 데이터와 신원 문서가 결합되어 있어 특히 심각한 것으로 평가됩니다.

유출 데이터의 내용

Mercor의 계약자 온보딩 파이프라인은 다음 정보를 수집했습니다:

- 정부 발행 신분증: 여권 또는 운전면허증 스캔본

- 웹캠 셀피: 본인 확인용 얼굴 사진

- 음성 녹음: 조용한 환경에서 스크립트를 읽는 고품질 음성 (계약자당 평균 2~5분 분량)

이 세 가지 데이터가 하나의 데이터베이스 행에 함께 저장되어 있어, 음성 복제 서비스가 필요로 하는 모든 입력값을 갖추고 있습니다.

위험성

현재 상용화된 오프더쉘프 음성 복제 도구는 약 15초의 고품질 음성 샘플만 있으면 동작합니다. Mercor에서 유출된 녹음은 이 기준을 훨씬 초과하며, 신분증과 결합될 경우 신원 도용, 딥페이크, 사기 등에 악용될 수 있습니다.

법적 대응

침해 공개 후 10일 이내에 5건의 집단 소송이 제기되었습니다. 원고들은 Mercor가 음성 데이터를 “훈련 데이터” 명목으로 수집하면서, 이것이 영구적인 생체 인식 식별자로 활용된다는 사실을 충분히 고지하지 않았다고 주장하고 있습니다.

확인 방법

만약 Mercor에서 AI 훈련 작업을 수행한 이력이 있다면, 해당 플랫폼의 공식 공지를 확인하고 비밀번호 변경 및 관련 계정 모니터링을 권장합니다.

[2026-04-28 / Top 3] 벽을 바라보는 남자들

벽 응시가 집중력과 생산성을 회복하는 데 도움이 된다는 개인적 실험 경험

원본 기사: https://www.alexselimov.com/posts/men_who_stare_at_walls/

개요

개발자 Alex Selimov가 정보 과부하로 집중력을 잃었을 때 아무것도 없는 벽을 바라보는 것이 얼마나 효과적인지 공유한 글입니다. 단순해 보이는 이 행동이 뇌를 리셋하고 집중력을 회복하는 데 실질적인 도움이 된다고 합니다.

핵심 아이디어

현대인은 끊임없는 알림, 소셜 미디어, 정보의 홍수 속에서 집중력 저하를 겪고 있습니다. 저자는 지쳐서 집중이 안 될 때 5~10분간 아무 생각 없이 벽을 바라보는 실험을 했고, 이후 집중력이 돌아오는 효과를 경험했습니다.

실천 방법

핵심 기법 두 가지를 결합:

- 초점 풀기(Out-of-focus 응시): 벽을 바라볼 때 초점을 맞추지 않고 주변 시야(peripheral vision)를 활성화합니다. 이는 부교감신경계를 자극해 이완 반응을 유도합니다.

- 마인드 블랭킹(Mind Blanking): 아무 생각도 하지 않으려고 의식적으로 노력합니다. 명상과 유사하지만 특별한 자세나 준비가 필요 없습니다.

실제 경험

5~10분 동안 벽을 바라보며 아무 생각도 하지 않는 것이 생각보다 어렵습니다. 하지만 이 시간을 마친 후에는 집중력이 현저히 회복된다고 저자는 증언합니다. 특별한 도구나 장소 없이 아무데서나 실천할 수 있다는 점도 장점입니다.

Hacker News 반응

이 글은 HN에서 큰 호응을 얻었으며, 많은 독자들이 비슷한 경험을 공유했습니다. 일부는 이를 “능동적 휴식(active rest)”이라고 부르며, 스마트폰을 보거나 유튜브를 시청하는 것과는 달리 뇌에 실질적인 휴식을 준다는 점에서 의미가 있다고 평가했습니다.

[2026-04-28 / Top 2] GitHub Copilot, 사용량 기반 과금 방식으로 전환

2026년 6월 1일부터 모든 GitHub Copilot 플랜이 AI 크레딧 기반 사용량 과금으로 전환됩니다

원본 기사: https://github.blog/news-insights/company-news/github-copilot-is-moving-to-usage-based-billing/

개요

GitHub이 2026년 6월 1일부터 Copilot의 모든 플랜을 사용량 기반 과금(Usage-Based Billing)으로 전환한다고 발표했습니다. AI 크레딧 시스템이 도입되며, 사용자는 월별 할당량 내에서 Copilot 기능을 사용하고 추가 사용 시 비용이 발생합니다.

과금 구조 변경

AI 크레딧 도입: 1 AI 크레딧 = $0.01 USD이며, 사용량은 입력·출력·캐시 토큰 소비량에 따라 계산됩니다.

플랜별 월 크레딧 포함량:

- Copilot Pro ($10/월): $10 상당의 AI 크레딧 포함

- Copilot Pro+ ($39/월): $39 상당의 AI 크레딧 포함

- Copilot Business ($19/사용자/월): 별도 크레딧 할당

- Copilot Enterprise ($39/사용자/월): 별도 크레딧 할당

크레딧을 소비하는 기능 vs. 무제한 기능

크레딧 소비 없는 기능 (모든 플랜 무제한):

- 코드 자동완성(Code Completions)

- Next Edit Suggestions

크레딧 소비 기능:

- Copilot Chat

- Copilot CLI

- Copilot 클라우드 에이전트

- Copilot Spaces

- Spark

- 서드파티 코딩 에이전트

연간 플랜 종료

연간 플랜은 폐지됩니다. 현재 연간 플랜 사용자는 구독 만료 시까지 기존 방식을 유지하고, 이후 새로운 월별 유료 플랜에 등록하지 않으면 Copilot Free로 전환됩니다.

개발자 반응

일부 개발자들은 “같은 금액을 내고 더 적게 받게 된다”며 부정적인 반응을 보이고 있습니다. 특히 Chat 기능을 많이 사용하는 사용자들은 월 크레딧 한도를 초과할 수 있어 사실상 비용 인상이라는 지적이 나오고 있습니다. 5월 초에 예상 청구서 미리보기 기능이 출시될 예정입니다.

[2026-04-28 / Top 1] 마이크로소프트와 오픈AI, 독점 및 수익 공유 계약 종료

마이크로소프트가 오픈AI와의 독점적 클라우드 파트너십 및 수익 공유 계약을 재편했습니다

개요

마이크로소프트와 오픈AI가 독점적 클라우드 파트너십 및 수익 공유 계약을 종료하고 파트너십을 전면 재편했습니다. 두 회사는 2026년 4월 27일 새로운 형태의 협력 관계를 공식 발표했습니다.

주요 변경 사항

독점 해제: 마이크로소프트의 오픈AI 기술 라이선스가 더 이상 독점적이지 않습니다. 이제 오픈AI는 아마존, 구글 등 다른 클라우드 제공업체와도 자유롭게 협력할 수 있게 되었습니다.

수익 공유 구조 변경: 기존에는 양사 간에 상호 수익 공유가 이루어졌으나, 이제 마이크로소프트는 오픈AI에 수익을 공유하지 않습니다. 오픈AI는 2030년까지 매출의 20%를 마이크로소프트에 계속 지불하되, 총액에 상한선이 적용됩니다.

AGI 조항 삭제: 마이크로소프트는 오픈AI가 인공일반지능(AGI)에 도달했다고 판단할 경우 취할 행동을 결정해야 하는 조항에서 벗어났습니다.

배경

오픈AI는 아마존과 최대 500억 달러 규모의 투자 계약을 체결하고, AWS와의 기존 380억 달러 계약을 향후 8년간 1,000억 달러로 확대하는 등 클라우드 다각화를 추진해왔습니다. 이번 재편을 통해 오픈AI는 AWS, 구글 클라우드 등 경쟁 플랫폼에서도 모든 제품을 고객에게 제공할 수 있게 되었습니다.

의미

이번 계약 재편은 AI 산업의 지형이 급변하고 있음을 보여줍니다. 마이크로소프트는 애저(Azure)를 통한 독점 공급권을 포기하는 대신, 더 광범위한 협력 관계를 유지하는 전략을 선택했습니다. 오픈AI 입장에서는 사업 확장의 유연성을 확보한 것으로 평가됩니다.

[2026-04-27 / Top 10] Sawe, 공식 경쟁 마라톤에서 최초로 2시간 미만 완주

케냐의 Sabastian Sawe가 2026 런던 마라톤에서 1:59:30으로 세계 신기록 수립

원본 기사: https://www.bbc.com/sport/athletics/articles/crm1m7e0zwzo

개요

2026년 4월 26일 런던 마라톤에서 케냐의 Sabastian Sawe가 1시간 59분 30초로 결승선을 통과하며 마라톤 역사에 새 장을 열었습니다. 이는 공식 경쟁 마라톤에서 인류 최초의 2시간 미만 완주로, 2023 시카고 마라톤에서 고 Kelvin Kiptum가 세운 2:00:35 기록을 무려 1분 5초 단축한 세계 신기록입니다.

주요 내용

- 역사적 기록: 1:59:30 – 공식 마라톤 대회에서 최초의 서브 2시간 완주. 이전 기록(2:00:35) 대비 65초 단축.

- Adidas 신발의 역할: Sawe와 에티오피아의 Yomif Kejelcha(1:59:41, 2위)는 모두 Adidas Adizero Adios Pro Evo 3를 착용했습니다. 2명이 동시에 서브 2시간을 달성한 최초의 레이스입니다.

- 레이스 하이라이트: Sawe는 버킹엄 궁 앞 The Mall에서 마지막 스프린트로 기록을 경신했습니다. BBC 해설자 Paula Radcliffe(전 런던 마라톤 우승자)는 “마라톤의 기준점이 방금 바뀌었다”고 말했습니다.

- Sawe의 소감: “나를 위해 기억에 남을 날입니다.”

- 맥락: Eliud Kipchoge는 2019년 비공식 페이스메이커와 맞춤형 코스를 이용한 ‘이네오스 1:59 챌린지’에서 1:59:40을 기록했지만 공식 기록으로 인정받지 못했습니다. Sawe의 기록은 일반 경쟁 대회에서 달성한 진정한 세계 최초입니다.

시사점

마라톤 2시간 장벽은 한때 인간의 생리적 한계로 여겨졌습니다. Sawe의 기록은 훈련 과학, 영양학, 신발 기술의 발전이 결합하여 이 한계를 넘어섰음을 보여줍니다. 육상계는 이제 서브 1:59, 나아가 1:58 도전의 시대를 맞이하고 있습니다.

[2026-04-27 / Top 9] SWE-bench Verified는 더 이상 최첨단 코딩 능력을 측정하지 않는다

훈련 데이터 오염과 결함 있는 테스트 케이스로 벤치마크 신뢰성이 붕괴되고 있다

원본 기사: https://openai.com/index/why-we-no-longer-evaluate-swe-bench-verified/

개요

OpenAI가 2026년 2월 SWE-bench Verified가 최첨단 AI 모델의 코딩 능력을 측정하는 데 더 이상 적합하지 않다고 공식 발표하며, 대신 SWE-bench Pro를 권장하겠다고 밝혔습니다. AI 코딩 벤치마크에 대한 신뢰성 위기를 보여주는 중요한 사례입니다.

문제의 원인

- 결함 있는 테스트 케이스: 감사된 문제의 최소 59.4%가 기능적으로 올바른 제출을 거부하는 결함 있는 테스트 케이스를 가지고 있습니다.

- 훈련 데이터 오염: 테스트된 모든 최첨단 모델이 특정 작업에서 원래의 인간이 작성한 버그 수정과 문제 진술 세부 사항을 재현할 수 있었습니다. 즉, 모델이 훈련 중에 문제에 노출되었을 가능성이 높습니다.

- 오염의 심각성: Claude Opus 4.5 기준으로 SWE-bench Verified에서 80.9%를 기록하지만, SWE-bench Pro에서는 45.9%에 그칩니다. 약 35%p의 괴리는 오염이 벤치마크 점수를 얼마나 부풀릴 수 있는지를 보여줍니다.

새로운 기준: SWE-bench Pro

SWE-bench Pro는 훈련 데이터 오염을 최소화하고, 더 현실적인 소프트웨어 개발 시나리오를 반영하도록 설계되었습니다. OpenAI는 이제 SWE-bench Pro에서의 성능을 보고할 것을 권장합니다.

시사점

AI 벤치마크의 신뢰성 문제는 점점 심각해지고 있습니다. 모델이 특정 벤치마크 데이터를 훈련 중에 접하고, 그 벤치마크에서 높은 점수를 얻어도 실제 능력을 반영하지 못하는 “벤치마크 오버피팅” 현상입니다. 진정한 AI 능력 평가를 위해서는 새로운 문제와 지속적인 벤치마크 갱신이 필수적입니다.

[2026-04-27 / Top 8] 상태차트: 계층적 상태 머신

복잡한 UI와 시스템 로직을 명확하게 모델링하는 상태차트의 개념과 실용적 활용법

원본 기사: https://statecharts.dev/

개요

statecharts.dev는 David Harel이 1987년 고안한 상태차트(Statecharts) 개념을 현대 소프트웨어 개발에 적용하는 방법을 다루는 사이트입니다. 일반 유한 상태 머신(FSM)의 한계를 극복하고 복잡한 상태 로직을 계층적·병렬적으로 표현하는 방법을 제공합니다.

상태차트의 핵심 개념

-

상태 폭발(State Explosion) 문제: 일반 FSM에서 새로운 조건을 추가할 때마다 상태와 전환이 기하급수적으로 늘어나는 문제입니다. 예를 들어 로딩·에러·성공 3개 상태와 인증 여부를 조합하면 6개 상태가 필요해집니다.

-

계층적 상태 (Hierarchical States): 상태 안에 하위 상태 머신을 정의할 수 있습니다. 하위 상태에서 처리되지 않은 이벤트는 자동으로 부모 상태가 처리합니다. 공통 동작을 부모 상태에 한 번만 정의하면 됩니다.

-

병렬(직교) 상태 (Parallel/Orthogonal States): 복합 상태를 독립적인 영역으로 분리해, 각 영역이 동시에 자신의 상태 머신을 실행할 수 있습니다. 예를 들어 UI 테마(라이트/다크)와 사용자 인증 상태를 독립적으로 관리할 수 있습니다.

-

가드와 지연 전환: 조건(가드)이 충족될 때만 전환이 발생하거나, 특정 시간이 지난 후 자동으로 상태가 전환됩니다.

현대 개발에서의 활용

상태차트는 XState(JavaScript/TypeScript), Robot, Stately 같은 라이브러리를 통해 프론트엔드 및 백엔드에서 폭넓게 활용됩니다. 복잡한 폼 로직, 멀티스텝 UI 플로우, 소켓 연결 상태 관리 등에 특히 유용합니다.

시사점

대부분의 버그는 예상치 못한 상태 조합에서 발생합니다. 상태차트는 시스템의 모든 가능한 상태를 명시적으로 정의하게 만들어, 암묵적이고 불가능한 상태를 설계 단계에서 제거합니다. 복잡한 로직을 직관적으로 시각화하고 테스트하기 쉬운 구조로 만드는 강력한 도구입니다.

[2026-04-27 / Top 7] AI는 당신의 사고를 향상시켜야지, 대체해서는 안 된다

AI로 잡무를 줄이는 사람과 생각 자체를 AI에 외주 맡기는 사람의 결정적 차이

원본 기사: https://www.koshyjohn.com/blog/ai-should-elevate-your-thinking-not-replace-it/

개요

Koshy John의 블로그 포스트는 AI 시대의 소프트웨어 엔지니어들이 두 그룹으로 나뉘고 있다고 지적합니다. AI를 통해 더 중요한 사고에 집중하는 그룹과, AI에 사고 자체를 맡겨버리는 그룹입니다. 이 차이가 장기적으로 역량의 극단적 양극화를 만들어낼 것이라고 경고합니다.

주요 내용

- 두 가지 AI 활용 패턴:

- 레버리지 그룹: AI를 잡무 제거 도구로 사용하며, 문제 정의·트레이드오프 분석·리스크 발굴·원래의 통찰 생성 등 핵심 사고에 더 많은 시간을 투자합니다.

- 의존 그룹: AI에 프롬프트를 입력하고 받은 결과물을 자신의 것인 양 전달합니다. 역량이 아닌 역량의 시뮬레이션만 갖추게 됩니다.

-

핵심 위험: AI가 도덕적 의미의 게으름을 만드는 것이 아니라, 역량을 실제로 쌓지 않아도 역량이 있는 것처럼 보이게 한다는 점이 진짜 위험입니다.

-

조직적 함의: AI를 잘 다루는 조직은 레버리지와 의존, 가속과 모방, 진짜 역량과 설득력 있는 결과물을 구분할 수 있는 리더십을 갖춘 조직입니다.

- 강한 엔지니어의 역할 변화: 역량 있는 엔지니어들이 AI로 생성된 얕은 결과물을 정리하는 데 불균형적인 시간을 쓰게 되는 문제도 지적합니다.

시사점

AI 도구의 빠른 확산 속에서 개인의 성장 방식과 조직의 채용·평가 기준이 근본적으로 변화해야 합니다. “AI를 활용해 더 빠르게”가 아닌 “AI를 활용해 더 깊게 생각하기”가 앞으로의 차별화 기준이 될 것입니다.

[2026-04-27 / Top 6] EU 나이 확인 앱: 디지털 신분증을 위한 트로이 목마

아동 보호 명분의 EU 나이 확인 시스템이 실은 전 유럽 디지털 ID 인프라의 발판이 된다는 분석

원본 기사: https://juraj.bednar.io/en/blog-en/2026/04/17/eu-age-control-the-trojan-horse-for-digital-ids/

개요

EU가 2026년 4월 15일 오픈소스 나이 확인 앱을 출시하며 전 회원국 구현 준비 완료를 선언했습니다. 표면적으로는 미성년자를 포르노 및 유해 소셜 미디어로부터 보호하는 기술이지만, 보안 연구자 Juraj Bednar는 이 시스템이 사실상 유럽 디지털 신분증 인프라 구축의 트로이 목마라고 분석합니다.

주요 내용

- 마케팅 vs. 실제 구현의 괴리: 공식 홍보는 영지식 증명(Zero-Knowledge Proof)을 통해 이름이나 생년월일 없이 18세 이상임만 증명한다고 했지만, 실제 참조 Android 앱은 ZK 라이브러리를 가져오기만 하고 실제 프레젠테이션 경로에서는 호출하지 않습니다. 대신 오래된 ISO 표준을 사용하여 속성을 미리 서명 처리합니다.